TensorFlow.org এ দেখুন TensorFlow.org এ দেখুন |  Google Colab-এ চালান Google Colab-এ চালান |  GitHub-এ উৎস দেখুন GitHub-এ উৎস দেখুন |  নোটবুক ডাউনলোড করুন নোটবুক ডাউনলোড করুন |

ওভারভিউ

সাধারণ ব্যবহারের ক্ষেত্রে টিএফএল মডেলগুলিকে প্রশিক্ষণ দেওয়ার জন্য টিনজাত অনুমানকারীগুলি দ্রুত এবং সহজ উপায়। এই নির্দেশিকাটি একটি TFL ক্যানড এস্টিমেটর তৈরি করার জন্য প্রয়োজনীয় পদক্ষেপগুলির রূপরেখা দেয়৷

সেটআপ

টিএফ ল্যাটিস প্যাকেজ ইনস্টল করা হচ্ছে:

pip install tensorflow-lattice

প্রয়োজনীয় প্যাকেজ আমদানি করা হচ্ছে:

import tensorflow as tf

import copy

import logging

import numpy as np

import pandas as pd

import sys

import tensorflow_lattice as tfl

from tensorflow import feature_column as fc

logging.disable(sys.maxsize)

ইউসিআই স্ট্যাটলগ (হার্ট) ডেটাসেট ডাউনলোড করা হচ্ছে:

csv_file = tf.keras.utils.get_file(

'heart.csv', 'http://storage.googleapis.com/download.tensorflow.org/data/heart.csv')

df = pd.read_csv(csv_file)

target = df.pop('target')

train_size = int(len(df) * 0.8)

train_x = df[:train_size]

train_y = target[:train_size]

test_x = df[train_size:]

test_y = target[train_size:]

df.head()

এই নির্দেশিকায় প্রশিক্ষণের জন্য ব্যবহৃত ডিফল্ট মান সেট করা:

LEARNING_RATE = 0.01

BATCH_SIZE = 128

NUM_EPOCHS = 500

PREFITTING_NUM_EPOCHS = 10

ফিচার কলাম

অন্য কোন মেমরি মূল্নির্ধারক হিসাবে, তথ্য চাহিদা মূল্নির্ধারক, যা একটি input_fn মাধ্যমে সাধারণত হয় উত্তীর্ণ হন এবং ব্যবহার বিশ্লেষণ হতে FeatureColumns ।

# Feature columns.

# - age

# - sex

# - cp chest pain type (4 values)

# - trestbps resting blood pressure

# - chol serum cholestoral in mg/dl

# - fbs fasting blood sugar > 120 mg/dl

# - restecg resting electrocardiographic results (values 0,1,2)

# - thalach maximum heart rate achieved

# - exang exercise induced angina

# - oldpeak ST depression induced by exercise relative to rest

# - slope the slope of the peak exercise ST segment

# - ca number of major vessels (0-3) colored by flourosopy

# - thal 3 = normal; 6 = fixed defect; 7 = reversable defect

feature_columns = [

fc.numeric_column('age', default_value=-1),

fc.categorical_column_with_vocabulary_list('sex', [0, 1]),

fc.numeric_column('cp'),

fc.numeric_column('trestbps', default_value=-1),

fc.numeric_column('chol'),

fc.categorical_column_with_vocabulary_list('fbs', [0, 1]),

fc.categorical_column_with_vocabulary_list('restecg', [0, 1, 2]),

fc.numeric_column('thalach'),

fc.categorical_column_with_vocabulary_list('exang', [0, 1]),

fc.numeric_column('oldpeak'),

fc.categorical_column_with_vocabulary_list('slope', [0, 1, 2]),

fc.numeric_column('ca'),

fc.categorical_column_with_vocabulary_list(

'thal', ['normal', 'fixed', 'reversible']),

]

TFL টিনজাত অনুমানকারীরা কী ধরণের ক্রমাঙ্কন স্তর ব্যবহার করবেন তা নির্ধারণ করতে বৈশিষ্ট্য কলামের ধরন ব্যবহার করে। আমরা একটি ব্যবহার tfl.layers.PWLCalibration সাংখ্যিক বৈশিষ্ট্য কলামের জন্য স্তর এবং একটি tfl.layers.CategoricalCalibration শ্রেণীগত বৈশিষ্ট্য কলামের জন্য স্তর।

মনে রাখবেন যে শ্রেণীবদ্ধ বৈশিষ্ট্য কলামগুলি একটি এম্বেডিং বৈশিষ্ট্য কলাম দ্বারা মোড়ানো হয় না। তারা সরাসরি অনুমানকারী মধ্যে খাওয়ানো হয়.

input_fn তৈরি করা হচ্ছে

অন্য কোনো অনুমানকারী হিসাবে, আপনি প্রশিক্ষণ এবং মূল্যায়নের জন্য মডেলে ডেটা ফিড করতে একটি input_fn ব্যবহার করতে পারেন। TFL অনুমানকারীরা স্বয়ংক্রিয়ভাবে বৈশিষ্ট্যগুলির কোয়ান্টাইল গণনা করতে পারে এবং সেগুলিকে PWL ক্রমাঙ্কন স্তরের জন্য ইনপুট কীপয়েন্ট হিসাবে ব্যবহার করতে পারে। এটা করার জন্য, তারা একটি ক্ষণস্থায়ী প্রয়োজন feature_analysis_input_fn , যা input_fn কিন্তু একটি একক যুগান্তকারী বা তথ্য একটি subsample সঙ্গে প্রশিক্ষণ অনুরূপ।

train_input_fn = tf.compat.v1.estimator.inputs.pandas_input_fn(

x=train_x,

y=train_y,

shuffle=False,

batch_size=BATCH_SIZE,

num_epochs=NUM_EPOCHS,

num_threads=1)

# feature_analysis_input_fn is used to collect statistics about the input.

feature_analysis_input_fn = tf.compat.v1.estimator.inputs.pandas_input_fn(

x=train_x,

y=train_y,

shuffle=False,

batch_size=BATCH_SIZE,

# Note that we only need one pass over the data.

num_epochs=1,

num_threads=1)

test_input_fn = tf.compat.v1.estimator.inputs.pandas_input_fn(

x=test_x,

y=test_y,

shuffle=False,

batch_size=BATCH_SIZE,

num_epochs=1,

num_threads=1)

# Serving input fn is used to create saved models.

serving_input_fn = (

tf.estimator.export.build_parsing_serving_input_receiver_fn(

feature_spec=fc.make_parse_example_spec(feature_columns)))

বৈশিষ্ট্য কনফিগার

বৈশিষ্ট্য ক্রমাঙ্কন এবং প্রতি-বৈশিষ্ট্য কনফিগারেশনের ব্যবহার নির্ধারণ করা হয় tfl.configs.FeatureConfig । বৈশিষ্ট্য কনফিগারেশনের monotonicity সীমাবদ্ধতা, প্রতি-বৈশিষ্ট্য নিয়মিতকরণ (দেখুন অন্তর্ভুক্ত tfl.configs.RegularizerConfig ), এবং জাফরি মডেলের জন্য জাফরি মাপ।

কোন কনফিগারেশন একটি ইনপুট বৈশিষ্ট্যের জন্য সংজ্ঞায়িত করা হয় তাহলে, ডিফল্ট কনফিগারেশন tfl.config.FeatureConfig ব্যবহার করা হয়।

# Feature configs are used to specify how each feature is calibrated and used.

feature_configs = [

tfl.configs.FeatureConfig(

name='age',

lattice_size=3,

# By default, input keypoints of pwl are quantiles of the feature.

pwl_calibration_num_keypoints=5,

monotonicity='increasing',

pwl_calibration_clip_max=100,

# Per feature regularization.

regularizer_configs=[

tfl.configs.RegularizerConfig(name='calib_wrinkle', l2=0.1),

],

),

tfl.configs.FeatureConfig(

name='cp',

pwl_calibration_num_keypoints=4,

# Keypoints can be uniformly spaced.

pwl_calibration_input_keypoints='uniform',

monotonicity='increasing',

),

tfl.configs.FeatureConfig(

name='chol',

# Explicit input keypoint initialization.

pwl_calibration_input_keypoints=[126.0, 210.0, 247.0, 286.0, 564.0],

monotonicity='increasing',

# Calibration can be forced to span the full output range by clamping.

pwl_calibration_clamp_min=True,

pwl_calibration_clamp_max=True,

# Per feature regularization.

regularizer_configs=[

tfl.configs.RegularizerConfig(name='calib_hessian', l2=1e-4),

],

),

tfl.configs.FeatureConfig(

name='fbs',

# Partial monotonicity: output(0) <= output(1)

monotonicity=[(0, 1)],

),

tfl.configs.FeatureConfig(

name='trestbps',

pwl_calibration_num_keypoints=5,

monotonicity='decreasing',

),

tfl.configs.FeatureConfig(

name='thalach',

pwl_calibration_num_keypoints=5,

monotonicity='decreasing',

),

tfl.configs.FeatureConfig(

name='restecg',

# Partial monotonicity: output(0) <= output(1), output(0) <= output(2)

monotonicity=[(0, 1), (0, 2)],

),

tfl.configs.FeatureConfig(

name='exang',

# Partial monotonicity: output(0) <= output(1)

monotonicity=[(0, 1)],

),

tfl.configs.FeatureConfig(

name='oldpeak',

pwl_calibration_num_keypoints=5,

monotonicity='increasing',

),

tfl.configs.FeatureConfig(

name='slope',

# Partial monotonicity: output(0) <= output(1), output(1) <= output(2)

monotonicity=[(0, 1), (1, 2)],

),

tfl.configs.FeatureConfig(

name='ca',

pwl_calibration_num_keypoints=4,

monotonicity='increasing',

),

tfl.configs.FeatureConfig(

name='thal',

# Partial monotonicity:

# output(normal) <= output(fixed)

# output(normal) <= output(reversible)

monotonicity=[('normal', 'fixed'), ('normal', 'reversible')],

),

]

ক্যালিব্রেটেড লিনিয়ার মডেল

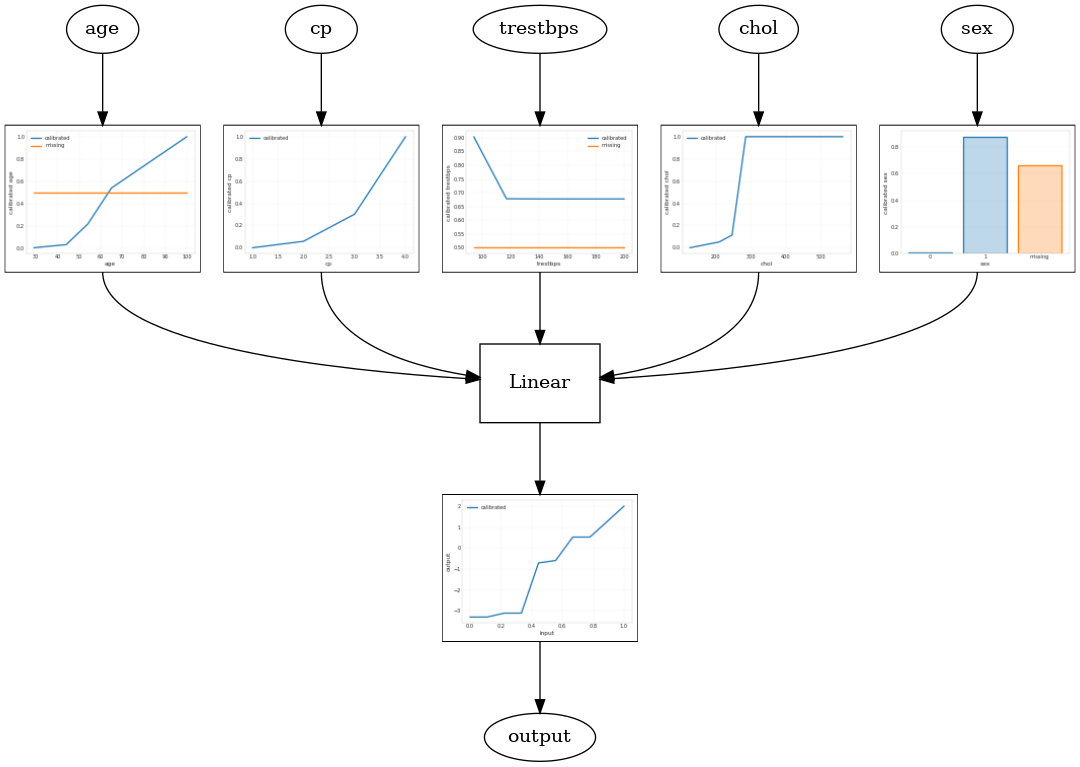

একটি TfL রেডিমেড মূল্নির্ধারক গঠন করা, থেকে একটি মডেল কনফিগারেশন গঠন করা tfl.configs । একটি মডেলটির ক্রমাঙ্ক রৈখিক মডেল ব্যবহার করে নির্মিত হয় tfl.configs.CalibratedLinearConfig । এটি ইনপুট বৈশিষ্ট্যগুলিতে টুকরো টুকরো-রৈখিক এবং শ্রেণীবদ্ধ ক্রমাঙ্কন প্রয়োগ করে, একটি রৈখিক সংমিশ্রণ এবং একটি ঐচ্ছিক আউটপুট পিসওয়াইজ-লিনিয়ার ক্রমাঙ্কন দ্বারা অনুসরণ করে। আউটপুট ক্রমাঙ্কন ব্যবহার করার সময় বা যখন আউটপুট সীমা নির্দিষ্ট করা হয়, রৈখিক স্তরটি ক্রমাঙ্কিত ইনপুটগুলিতে ওজনযুক্ত গড় প্রয়োগ করবে।

এই উদাহরণটি প্রথম 5টি বৈশিষ্ট্যের উপর একটি ক্যালিব্রেটেড লিনিয়ার মডেল তৈরি করে। আমরা ব্যবহার tfl.visualization ক্যালিব্রেটর প্লট সঙ্গে মডেল গ্রাফ প্লটে বিভক্ত করা হয়।

# Model config defines the model structure for the estimator.

model_config = tfl.configs.CalibratedLinearConfig(

feature_configs=feature_configs,

use_bias=True,

output_calibration=True,

regularizer_configs=[

# Regularizer for the output calibrator.

tfl.configs.RegularizerConfig(name='output_calib_hessian', l2=1e-4),

])

# A CannedClassifier is constructed from the given model config.

estimator = tfl.estimators.CannedClassifier(

feature_columns=feature_columns[:5],

model_config=model_config,

feature_analysis_input_fn=feature_analysis_input_fn,

optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

config=tf.estimator.RunConfig(tf_random_seed=42))

estimator.train(input_fn=train_input_fn)

results = estimator.evaluate(input_fn=test_input_fn)

print('Calibrated linear test AUC: {}'.format(results['auc']))

saved_model_path = estimator.export_saved_model(estimator.model_dir,

serving_input_fn)

model_graph = tfl.estimators.get_model_graph(saved_model_path)

tfl.visualization.draw_model_graph(model_graph)

2021-09-30 20:54:06.660239: E tensorflow/stream_executor/cuda/cuda_driver.cc:271] failed call to cuInit: CUDA_ERROR_NO_DEVICE: no CUDA-capable device is detected Calibrated linear test AUC: 0.834586501121521

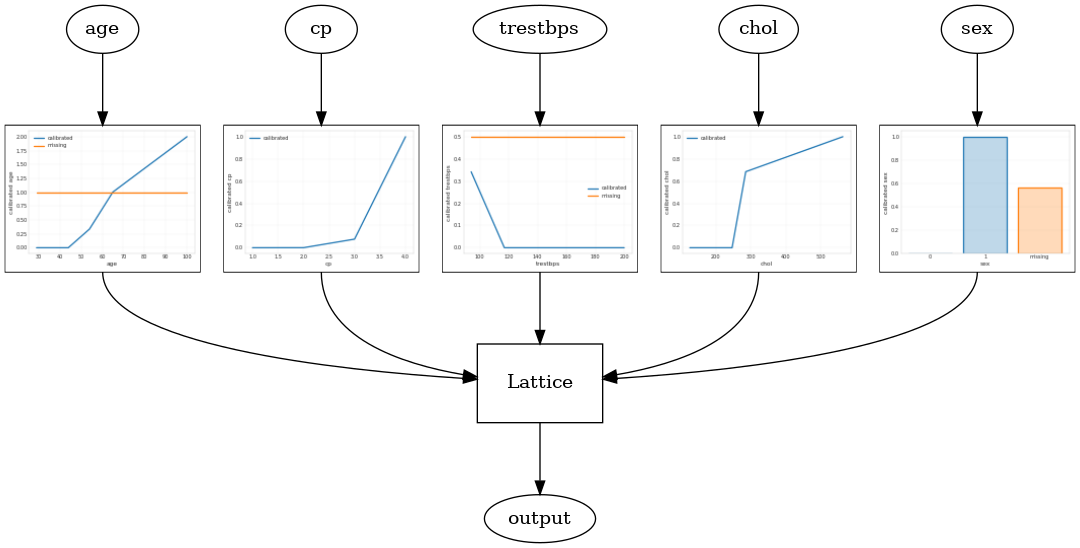

ক্যালিব্রেটেড ল্যাটিস মডেল

একটি মডেলটির ক্রমাঙ্ক জাফরি মডেল ব্যবহার করে নির্মিত হয় tfl.configs.CalibratedLatticeConfig । একটি ক্যালিব্রেটেড জালি মডেল ইনপুট বৈশিষ্ট্যগুলিতে টুকরো টুকরো-রৈখিক এবং শ্রেণীবদ্ধ ক্রমাঙ্কন প্রয়োগ করে, তারপরে একটি জালি মডেল এবং একটি ঐচ্ছিক আউটপুট পিসওয়াইজ-লিনিয়ার ক্রমাঙ্কন।

এই উদাহরণটি প্রথম 5টি বৈশিষ্ট্যের উপর একটি ক্যালিব্রেটেড জালি মডেল তৈরি করে।

# This is calibrated lattice model: Inputs are calibrated, then combined

# non-linearly using a lattice layer.

model_config = tfl.configs.CalibratedLatticeConfig(

feature_configs=feature_configs,

regularizer_configs=[

# Torsion regularizer applied to the lattice to make it more linear.

tfl.configs.RegularizerConfig(name='torsion', l2=1e-4),

# Globally defined calibration regularizer is applied to all features.

tfl.configs.RegularizerConfig(name='calib_hessian', l2=1e-4),

])

# A CannedClassifier is constructed from the given model config.

estimator = tfl.estimators.CannedClassifier(

feature_columns=feature_columns[:5],

model_config=model_config,

feature_analysis_input_fn=feature_analysis_input_fn,

optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

config=tf.estimator.RunConfig(tf_random_seed=42))

estimator.train(input_fn=train_input_fn)

results = estimator.evaluate(input_fn=test_input_fn)

print('Calibrated lattice test AUC: {}'.format(results['auc']))

saved_model_path = estimator.export_saved_model(estimator.model_dir,

serving_input_fn)

model_graph = tfl.estimators.get_model_graph(saved_model_path)

tfl.visualization.draw_model_graph(model_graph)

Calibrated lattice test AUC: 0.8427318930625916

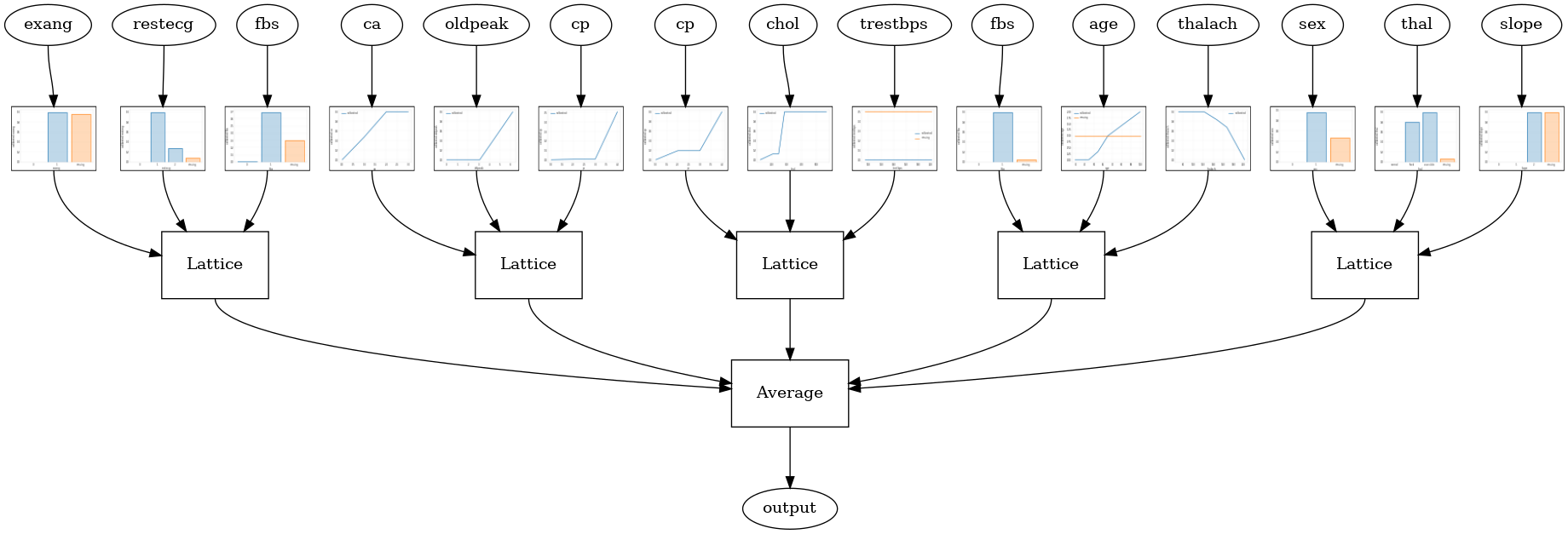

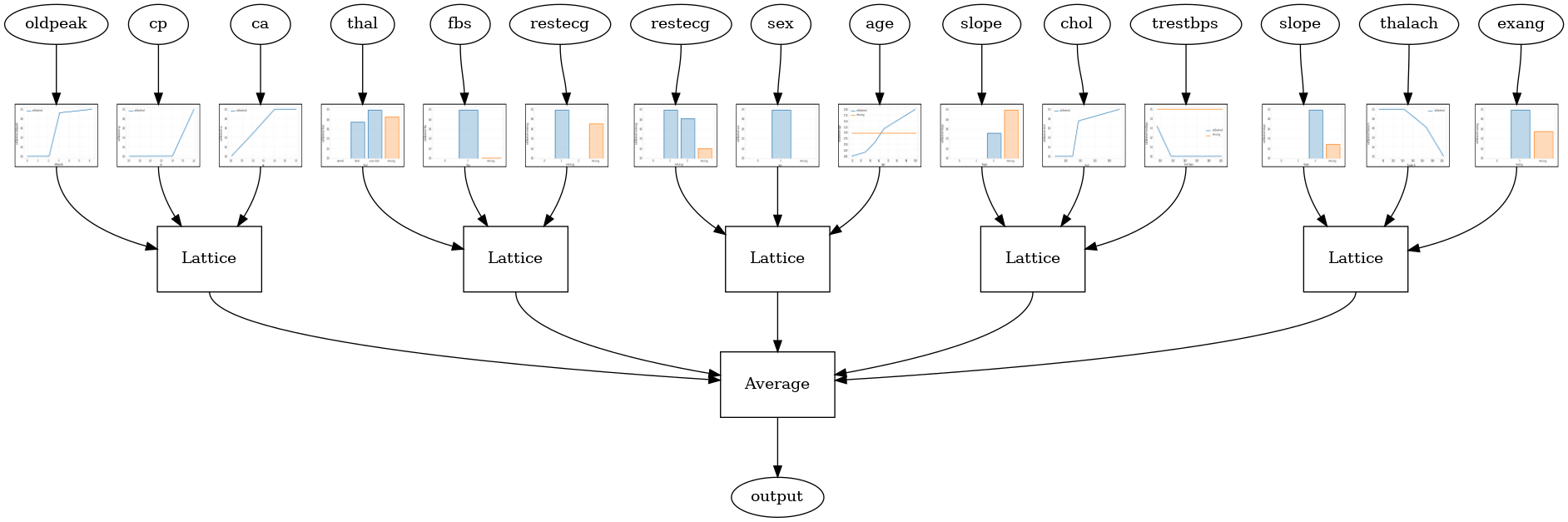

ক্যালিব্রেটেড ল্যাটিস এনসেম্বল

বৈশিষ্ট্যের সংখ্যা বড় হলে, আপনি একটি ensemble মডেল ব্যবহার করতে পারেন, যা বৈশিষ্ট্যগুলির উপসেটের জন্য একাধিক ছোট জালি তৈরি করে এবং শুধুমাত্র একটি বিশাল জালি তৈরি করার পরিবর্তে তাদের আউটপুট গড় করে। আঁসাঁব্ল জাফরি মডেল ব্যবহার করে নির্মিত হয় tfl.configs.CalibratedLatticeEnsembleConfig । একটি ক্যালিব্রেটেড ল্যাটিস এনসেম্বল মডেল ইনপুট বৈশিষ্ট্যে টুকরো টুকরো-রৈখিক এবং শ্রেণীবদ্ধ ক্রমাঙ্কন প্রয়োগ করে, তারপরে জালি মডেলগুলির একটি অংশ এবং একটি ঐচ্ছিক আউটপুট পিসওয়াইজ-লিনিয়ার ক্রমাঙ্কন প্রয়োগ করে।

এলোমেলো ল্যাটিস এনসেম্বল

নিম্নলিখিত মডেল কনফিগারেশন প্রতিটি জালির জন্য বৈশিষ্ট্যগুলির একটি র্যান্ডম উপসেট ব্যবহার করে।

# This is random lattice ensemble model with separate calibration:

# model output is the average output of separately calibrated lattices.

model_config = tfl.configs.CalibratedLatticeEnsembleConfig(

feature_configs=feature_configs,

num_lattices=5,

lattice_rank=3)

# A CannedClassifier is constructed from the given model config.

estimator = tfl.estimators.CannedClassifier(

feature_columns=feature_columns,

model_config=model_config,

feature_analysis_input_fn=feature_analysis_input_fn,

optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

config=tf.estimator.RunConfig(tf_random_seed=42))

estimator.train(input_fn=train_input_fn)

results = estimator.evaluate(input_fn=test_input_fn)

print('Random ensemble test AUC: {}'.format(results['auc']))

saved_model_path = estimator.export_saved_model(estimator.model_dir,

serving_input_fn)

model_graph = tfl.estimators.get_model_graph(saved_model_path)

tfl.visualization.draw_model_graph(model_graph, calibrator_dpi=15)

Random ensemble test AUC: 0.9003759026527405

RTL লেয়ার র্যান্ডম ল্যাটিস এনসেম্বল

নিম্নলিখিত মডেল কনফিগ একটি ব্যবহার tfl.layers.RTL স্তর প্রতিটি জাফরি জন্য বৈশিষ্ট্য একটি র্যান্ডম উপসেট ব্যবহার করে। আমরা লক্ষ করুন যে, tfl.layers.RTL শুধুমাত্র monotonicity সীমাবদ্ধতার সমর্থন করে এবং সমস্ত বৈশিষ্ট্য জন্য একই জাফরি আকার এবং কোন প্রতি-বৈশিষ্ট্য নিয়মিতকরণ থাকতে হবে। লক্ষ্য করুন, একটি ব্যবহার করে tfl.layers.RTL স্তর আপনি পৃথক ব্যবহার চেয়ে অনেক বড় ensembles আকার পরিবর্তন করতে দেয় tfl.layers.Lattice দৃষ্টান্ত।

# Make sure our feature configs have the same lattice size, no per-feature

# regularization, and only monotonicity constraints.

rtl_layer_feature_configs = copy.deepcopy(feature_configs)

for feature_config in rtl_layer_feature_configs:

feature_config.lattice_size = 2

feature_config.unimodality = 'none'

feature_config.reflects_trust_in = None

feature_config.dominates = None

feature_config.regularizer_configs = None

# This is RTL layer ensemble model with separate calibration:

# model output is the average output of separately calibrated lattices.

model_config = tfl.configs.CalibratedLatticeEnsembleConfig(

lattices='rtl_layer',

feature_configs=rtl_layer_feature_configs,

num_lattices=5,

lattice_rank=3)

# A CannedClassifier is constructed from the given model config.

estimator = tfl.estimators.CannedClassifier(

feature_columns=feature_columns,

model_config=model_config,

feature_analysis_input_fn=feature_analysis_input_fn,

optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

config=tf.estimator.RunConfig(tf_random_seed=42))

estimator.train(input_fn=train_input_fn)

results = estimator.evaluate(input_fn=test_input_fn)

print('Random ensemble test AUC: {}'.format(results['auc']))

saved_model_path = estimator.export_saved_model(estimator.model_dir,

serving_input_fn)

model_graph = tfl.estimators.get_model_graph(saved_model_path)

tfl.visualization.draw_model_graph(model_graph, calibrator_dpi=15)

Random ensemble test AUC: 0.8903509378433228

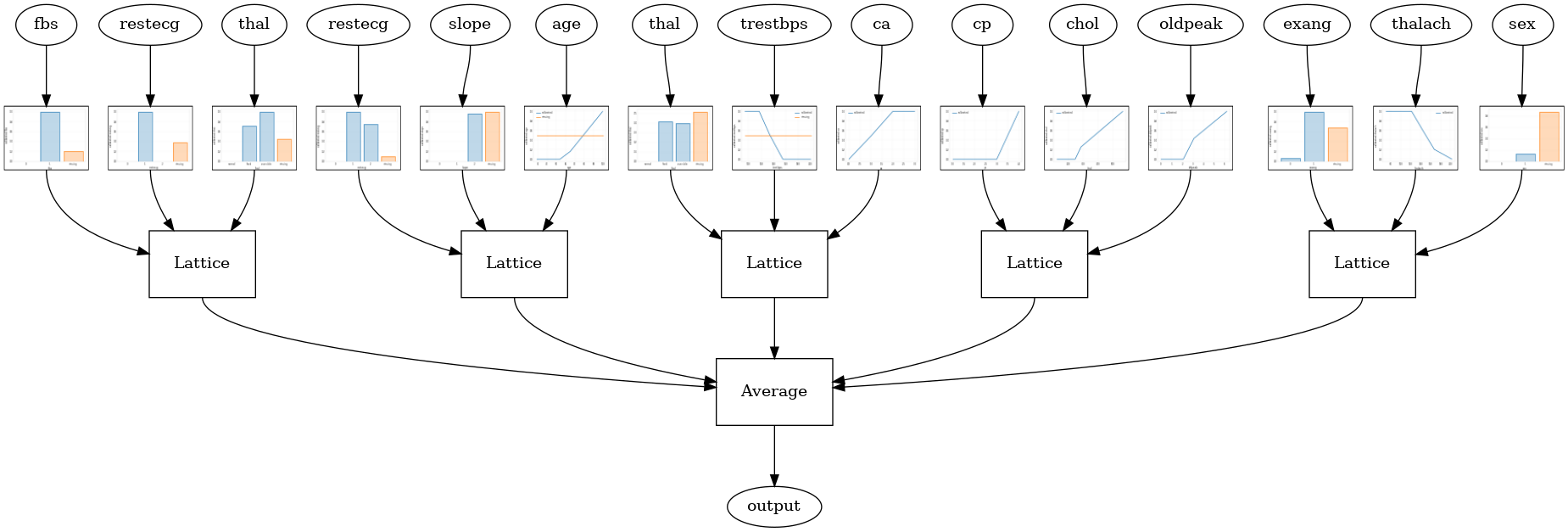

ক্রিস্টাল ল্যাটিস এনসেম্বল

TfL একটি অনুসন্ধানমূলক বৈশিষ্ট্য ব্যবস্থা অ্যালগরিদম নামক উপলব্ধ স্ফটিক । স্ফটিক প্রথম ট্রেন অ্যালগরিদম একটি prefitting মডেল যে অনুমান বৈশিষ্ট্য পারস্পরিক ক্রিয়ার pairwise। তারপরে এটি চূড়ান্ত সংযোজনটি এমনভাবে সাজায় যাতে আরও নন-লিনিয়ার মিথস্ক্রিয়া সহ বৈশিষ্ট্যগুলি একই জালিতে থাকে।

স্ফটিক মডেলের জন্য, আপনি একটি প্রদান করতে হবে prefitting_input_fn উপরে বর্ণিত যে, prefitting মডেল প্রশিক্ষণ করতে ব্যবহৃত হয়। প্রিফিটিং মডেলটিকে সম্পূর্ণভাবে প্রশিক্ষিত করার প্রয়োজন নেই, তাই কয়েকটি যুগ যথেষ্ট হওয়া উচিত।

prefitting_input_fn = tf.compat.v1.estimator.inputs.pandas_input_fn(

x=train_x,

y=train_y,

shuffle=False,

batch_size=BATCH_SIZE,

num_epochs=PREFITTING_NUM_EPOCHS,

num_threads=1)

এর পরে আপনি সেট করে একটি ক্রিস্টাল মডেল তৈরি করতে পারেন lattice='crystals' মডেল কনফিগ হবে।

# This is Crystals ensemble model with separate calibration: model output is

# the average output of separately calibrated lattices.

model_config = tfl.configs.CalibratedLatticeEnsembleConfig(

feature_configs=feature_configs,

lattices='crystals',

num_lattices=5,

lattice_rank=3)

# A CannedClassifier is constructed from the given model config.

estimator = tfl.estimators.CannedClassifier(

feature_columns=feature_columns,

model_config=model_config,

feature_analysis_input_fn=feature_analysis_input_fn,

# prefitting_input_fn is required to train the prefitting model.

prefitting_input_fn=prefitting_input_fn,

optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

prefitting_optimizer=tf.keras.optimizers.Adam(LEARNING_RATE),

config=tf.estimator.RunConfig(tf_random_seed=42))

estimator.train(input_fn=train_input_fn)

results = estimator.evaluate(input_fn=test_input_fn)

print('Crystals ensemble test AUC: {}'.format(results['auc']))

saved_model_path = estimator.export_saved_model(estimator.model_dir,

serving_input_fn)

model_graph = tfl.estimators.get_model_graph(saved_model_path)

tfl.visualization.draw_model_graph(model_graph, calibrator_dpi=15)

Crystals ensemble test AUC: 0.8840851783752441

ব্যবহার করে আপনি আরো বিস্তারিত দিয়ে বৈশিষ্ট্য calibrators প্লটে বিভক্ত করতে পারেন tfl.visualization মডিউল।

_ = tfl.visualization.plot_feature_calibrator(model_graph, "age")

_ = tfl.visualization.plot_feature_calibrator(model_graph, "restecg")