Сегментаторы изображений предсказывают, связан ли каждый пиксель изображения с определенным классом. В этом отличие от обнаружения объектов , которое обнаруживает объекты в прямоугольных областях, и классификации изображений , которая классифицирует все изображение. Дополнительную информацию о сегментаторах изображений см. в обзоре сегментации изображений.

Используйте API ImageSegmenter библиотеки задач, чтобы развернуть собственные или предварительно обученные сегментаторы изображений в своих мобильных приложениях.

Ключевые особенности API ImageSegmenter

Обработка входного изображения, включая вращение, изменение размера и преобразование цветового пространства.

Метка локали карты.

Два типа вывода: маска категории и маски достоверности.

Цветная этикетка для наглядности.

Поддерживаемые модели сегментаторов изображений

Следующие модели гарантированно совместимы с API ImageSegmenter .

Предварительно обученные модели сегментации изображений на TensorFlow Hub .

Пользовательские модели, соответствующие требованиям совместимости моделей .

Запустить вывод в Java

См. справочное приложение по сегментации изображений , где приведен пример использования ImageSegmenter в приложении для Android.

Шаг 1. Импортируйте зависимости Gradle и другие настройки.

Скопируйте файл модели .tflite в каталог ресурсов модуля Android, где будет запускаться модель. Укажите, что файл не должен быть сжат, и добавьте библиотеку TensorFlow Lite в файл build.gradle модуля:

android {

// Other settings

// Specify tflite file should not be compressed for the app apk

aaptOptions {

noCompress "tflite"

}

}

dependencies {

// Other dependencies

// Import the Task Vision Library dependency (NNAPI is included)

implementation 'org.tensorflow:tensorflow-lite-task-vision'

// Import the GPU delegate plugin Library for GPU inference

implementation 'org.tensorflow:tensorflow-lite-gpu-delegate-plugin'

}

Шаг 2: Использование модели

// Initialization

ImageSegmenterOptions options =

ImageSegmenterOptions.builder()

.setBaseOptions(BaseOptions.builder().useGpu().build())

.setOutputType(OutputType.CONFIDENCE_MASK)

.build();

ImageSegmenter imageSegmenter =

ImageSegmenter.createFromFileAndOptions(context, modelFile, options);

// Run inference

List<Segmentation> results = imageSegmenter.segment(image);

Дополнительные параметры настройки ImageSegmenter см . в исходном коде и документации Javadoc .

Запустить вывод в iOS

Шаг 1. Установите зависимости

Библиотека задач поддерживает установку с использованием CocoaPods. Убедитесь, что CocoaPods установлен в вашей системе. Инструкции см. в руководстве по установке CocoaPods .

Подробную информацию о добавлении модулей в проект Xcode см. в руководстве CocoaPods .

Добавьте модуль TensorFlowLiteTaskVision в Podfile.

target 'MyAppWithTaskAPI' do

use_frameworks!

pod 'TensorFlowLiteTaskVision'

end

Убедитесь, что модель .tflite , которую вы будете использовать для вывода, присутствует в вашем пакете приложений.

Шаг 2: Использование модели

Быстрый

// Imports

import TensorFlowLiteTaskVision

// Initialization

guard let modelPath = Bundle.main.path(forResource: "deeplabv3",

ofType: "tflite") else { return }

let options = ImageSegmenterOptions(modelPath: modelPath)

// Configure any additional options:

// options.outputType = OutputType.confidenceMasks

let segmenter = try ImageSegmenter.segmenter(options: options)

// Convert the input image to MLImage.

// There are other sources for MLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

guard let image = UIImage (named: "plane.jpg"), let mlImage = MLImage(image: image) else { return }

// Run inference

let segmentationResult = try segmenter.segment(mlImage: mlImage)

Цель С

// Imports

#import <TensorFlowLiteTaskVision/TensorFlowLiteTaskVision.h>

// Initialization

NSString *modelPath = [[NSBundle mainBundle] pathForResource:@"deeplabv3" ofType:@"tflite"];

TFLImageSegmenterOptions *options =

[[TFLImageSegmenterOptions alloc] initWithModelPath:modelPath];

// Configure any additional options:

// options.outputType = TFLOutputTypeConfidenceMasks;

TFLImageSegmenter *segmenter = [TFLImageSegmenter imageSegmenterWithOptions:options

error:nil];

// Convert the input image to MLImage.

UIImage *image = [UIImage imageNamed:@"plane.jpg"];

// There are other sources for GMLImage. For more details, please see:

// https://developers.google.com/ml-kit/reference/ios/mlimage/api/reference/Classes/GMLImage

GMLImage *gmlImage = [[GMLImage alloc] initWithImage:image];

// Run inference

TFLSegmentationResult *segmentationResult =

[segmenter segmentWithGMLImage:gmlImage error:nil];

Дополнительные параметры настройки TFLImageSegmenter см. в исходном коде .

Запустить вывод в Python

Шаг 1. Установите пакет pip

pip install tflite-support

Шаг 2: Использование модели

# Imports

from tflite_support.task import vision

from tflite_support.task import core

from tflite_support.task import processor

# Initialization

base_options = core.BaseOptions(file_name=model_path)

segmentation_options = processor.SegmentationOptions(

output_type=processor.SegmentationOptions.output_type.CATEGORY_MASK)

options = vision.ImageSegmenterOptions(base_options=base_options, segmentation_options=segmentation_options)

segmenter = vision.ImageSegmenter.create_from_options(options)

# Alternatively, you can create an image segmenter in the following manner:

# segmenter = vision.ImageSegmenter.create_from_file(model_path)

# Run inference

image_file = vision.TensorImage.create_from_file(image_path)

segmentation_result = segmenter.segment(image_file)

Дополнительные параметры настройки ImageSegmenter см. в исходном коде .

Запустить вывод на C++

// Initialization

ImageSegmenterOptions options;

options.mutable_base_options()->mutable_model_file()->set_file_name(model_path);

std::unique_ptr<ImageSegmenter> image_segmenter = ImageSegmenter::CreateFromOptions(options).value();

// Create input frame_buffer from your inputs, `image_data` and `image_dimension`.

// See more information here: tensorflow_lite_support/cc/task/vision/utils/frame_buffer_common_utils.h

std::unique_ptr<FrameBuffer> frame_buffer = CreateFromRgbRawBuffer(

image_data, image_dimension);

// Run inference

const SegmentationResult result = image_segmenter->Segment(*frame_buffer).value();

Дополнительные параметры настройки ImageSegmenter см. в исходном коде .

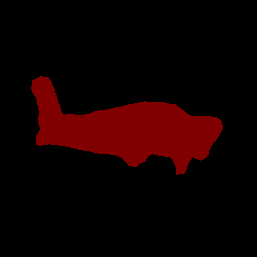

Примеры результатов

Вот пример результатов сегментации deeplab_v3 , общей модели сегментации, доступной в TensorFlow Hub.

Color Legend:

(r: 000, g: 000, b: 000):

index : 0

class name : background

(r: 128, g: 000, b: 000):

index : 1

class name : aeroplane

# (omitting multiple lines for conciseness) ...

(r: 128, g: 192, b: 000):

index : 19

class name : train

(r: 000, g: 064, b: 128):

index : 20

class name : tv

Tip: use a color picker on the output PNG file to inspect the output mask with

this legend.

Маска категории сегментации должна выглядеть так:

Попробуйте простой демонстрационный инструмент CLI для ImageSegmenter с вашей собственной моделью и тестовыми данными.

Требования совместимости модели

API ImageSegmenter ожидает модель TFLite с обязательными метаданными модели TFLite . См. примеры создания метаданных для сегментаторов изображений с помощью API TensorFlow Lite Metadata Writer .

Тензор входного изображения (kTfLiteUInt8/kTfLiteFloat32)

- Ввод изображения размера

[batch x height x width x channels]. - Пакетный вывод не поддерживается (

batchдолжен быть равен 1). - поддерживаются только входы RGB (

channelsдолжно быть 3). - если тип — kTfLiteFloat32, параметры NormalizationOptions необходимо прикрепить к метаданным для нормализации ввода.

- Ввод изображения размера

Тензор выходных масок: (kTfLiteUInt8/kTfLiteFloat32)

- тензор размера

[batch x mask_height x mask_width x num_classes], гдеbatchдолжен быть равен 1,mask_widthиmask_height— это размеры масок сегментации, созданных моделью, аnum_classes— это количество классов, поддерживаемых моделью. - необязательные (но рекомендуемые) карты меток могут быть прикреплены как AssociatedFile-s с типом TENSOR_AXIS_LABELS, содержащими одну метку в строке. Первый такой AssociatedFile (если есть) используется для заполнения поля

label(названного в C++class_name) результатов. Полеdisplay_nameзаполняется из AssociatedFile (если есть), языковой стандарт которого соответствует полюdisplay_names_localeImageSegmenterOptions, используемому во время создания («en» по умолчанию, т. е. английский). Если ни один из них недоступен, будет заполнено только полеindexрезультатов.

- тензор размера