Посмотреть на TensorFlow.org Посмотреть на TensorFlow.org |  Запускаем в Google Colab Запускаем в Google Colab |  Посмотреть исходный код на GitHub Посмотреть исходный код на GitHub |  Скачать блокнот Скачать блокнот |  См. Модель TF Hub См. Модель TF Hub |

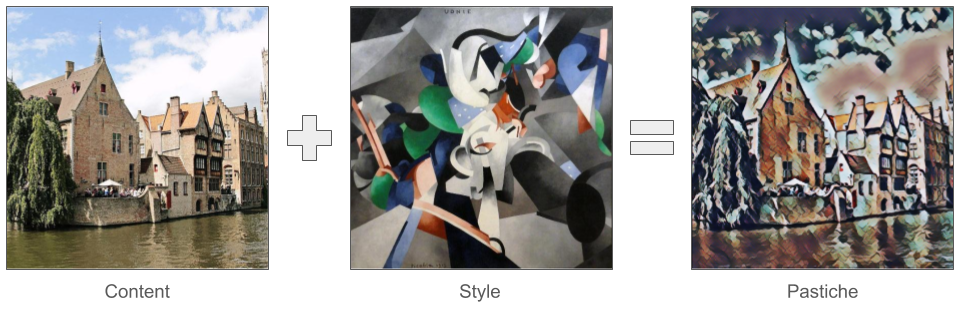

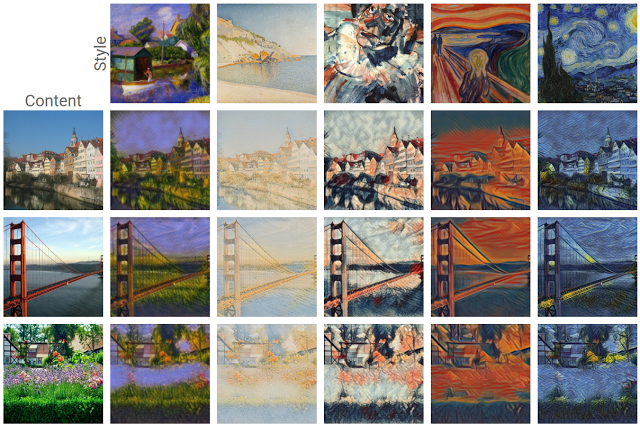

Одним из самых захватывающих событий в глубоком обучении , чтобы выйти в последнее время является художественной передачей стиля , или способности создать новый образ, известный как стилизация , основанный на два входных изображениях: один , представляющий художественный стиль и один , представляющую содержимое.

Используя эту технику, мы можем создавать новые красивые произведения искусства в различных стилях.

Если вы новичок в TensorFlow Lite и работаете с Android, мы рекомендуем изучить следующие примеры приложений, которые помогут вам начать работу.

Если вы используете платформу другой , чем Android или IOS, или вы уже знакомы с Lite API , TensorFlow , вы можете следить за этот учебник , чтобы узнать , как применить передачу стиля на любой паре содержания и стиля изображения с заранее подготовленных TensorFlow Lite модель. Вы можете использовать модель, чтобы добавить перенос стиля в свои собственные мобильные приложения.

Модель с открытым кодом на GitHub . Вы можете переобучить модель с другими параметрами (например, увеличить веса слоев содержимого, чтобы выходное изображение больше походило на изображение содержимого).

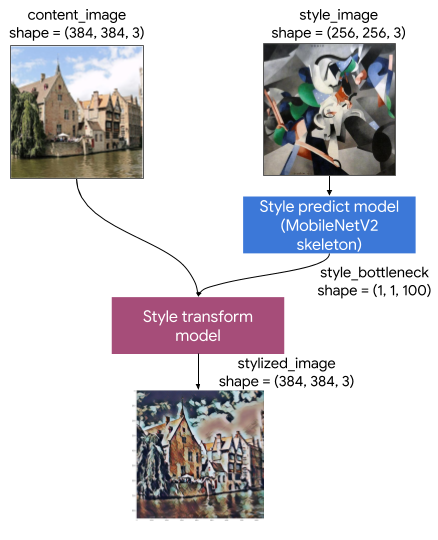

Понять архитектуру модели

Эта модель передачи художественного стиля состоит из двух подмоделей:

- Стиль Prediciton Модель: A MobilenetV2 на основе нейронной сети , которая принимает изображение ввода стиля в стиль узкого вектора в 100-измерения.

- Стиль Transform Model: нейронная сеть , которая принимает применить вектор стиля узкого места на изображение контента и создает стилизованное изображение.

Если ваше приложение должно поддерживать только фиксированный набор изображений стилей, вы можете заранее вычислить их векторы узких мест и исключить модель прогнозирования стиля из двоичного файла приложения.

Настраивать

Импортируйте зависимости.

import tensorflow as tf

print(tf.__version__)

2.6.0

import IPython.display as display

import matplotlib.pyplot as plt

import matplotlib as mpl

mpl.rcParams['figure.figsize'] = (12,12)

mpl.rcParams['axes.grid'] = False

import numpy as np

import time

import functools

Загрузите изображения содержимого и стилей, а также предварительно обученные модели TensorFlow Lite.

content_path = tf.keras.utils.get_file('belfry.jpg','https://storage.googleapis.com/khanhlvg-public.appspot.com/arbitrary-style-transfer/belfry-2611573_1280.jpg')

style_path = tf.keras.utils.get_file('style23.jpg','https://storage.googleapis.com/khanhlvg-public.appspot.com/arbitrary-style-transfer/style23.jpg')

style_predict_path = tf.keras.utils.get_file('style_predict.tflite', 'https://tfhub.dev/google/lite-model/magenta/arbitrary-image-stylization-v1-256/int8/prediction/1?lite-format=tflite')

style_transform_path = tf.keras.utils.get_file('style_transform.tflite', 'https://tfhub.dev/google/lite-model/magenta/arbitrary-image-stylization-v1-256/int8/transfer/1?lite-format=tflite')

Downloading data from https://storage.googleapis.com/khanhlvg-public.appspot.com/arbitrary-style-transfer/belfry-2611573_1280.jpg 458752/458481 [==============================] - 0s 0us/step 466944/458481 [==============================] - 0s 0us/step Downloading data from https://storage.googleapis.com/khanhlvg-public.appspot.com/arbitrary-style-transfer/style23.jpg 114688/108525 [===============================] - 0s 0us/step 122880/108525 [=================================] - 0s 0us/step Downloading data from https://tfhub.dev/google/lite-model/magenta/arbitrary-image-stylization-v1-256/int8/prediction/1?lite-format=tflite 2834432/2828838 [==============================] - 0s 0us/step 2842624/2828838 [==============================] - 0s 0us/step Downloading data from https://tfhub.dev/google/lite-model/magenta/arbitrary-image-stylization-v1-256/int8/transfer/1?lite-format=tflite 286720/284398 [==============================] - 0s 0us/step 294912/284398 [===============================] - 0s 0us/step

Предварительная обработка входных данных

- Изображение содержимого и изображение стиля должны быть изображениями RGB со значениями пикселей, являющимися числами float32 между [0..1].

- Размер изображения стиля должен быть (1, 256, 256, 3). Мы обрезаем изображение по центру и меняем его размер.

- Изображение содержимого должно быть (1, 384, 384, 3). Мы обрезаем изображение по центру и меняем его размер.

# Function to load an image from a file, and add a batch dimension.

def load_img(path_to_img):

img = tf.io.read_file(path_to_img)

img = tf.io.decode_image(img, channels=3)

img = tf.image.convert_image_dtype(img, tf.float32)

img = img[tf.newaxis, :]

return img

# Function to pre-process by resizing an central cropping it.

def preprocess_image(image, target_dim):

# Resize the image so that the shorter dimension becomes 256px.

shape = tf.cast(tf.shape(image)[1:-1], tf.float32)

short_dim = min(shape)

scale = target_dim / short_dim

new_shape = tf.cast(shape * scale, tf.int32)

image = tf.image.resize(image, new_shape)

# Central crop the image.

image = tf.image.resize_with_crop_or_pad(image, target_dim, target_dim)

return image

# Load the input images.

content_image = load_img(content_path)

style_image = load_img(style_path)

# Preprocess the input images.

preprocessed_content_image = preprocess_image(content_image, 384)

preprocessed_style_image = preprocess_image(style_image, 256)

print('Style Image Shape:', preprocessed_style_image.shape)

print('Content Image Shape:', preprocessed_content_image.shape)

Style Image Shape: (1, 256, 256, 3) Content Image Shape: (1, 384, 384, 3)

Визуализируйте входы

def imshow(image, title=None):

if len(image.shape) > 3:

image = tf.squeeze(image, axis=0)

plt.imshow(image)

if title:

plt.title(title)

plt.subplot(1, 2, 1)

imshow(preprocessed_content_image, 'Content Image')

plt.subplot(1, 2, 2)

imshow(preprocessed_style_image, 'Style Image')

Запуск переноса стилей с помощью TensorFlow Lite

Предсказание стиля

# Function to run style prediction on preprocessed style image.

def run_style_predict(preprocessed_style_image):

# Load the model.

interpreter = tf.lite.Interpreter(model_path=style_predict_path)

# Set model input.

interpreter.allocate_tensors()

input_details = interpreter.get_input_details()

interpreter.set_tensor(input_details[0]["index"], preprocessed_style_image)

# Calculate style bottleneck.

interpreter.invoke()

style_bottleneck = interpreter.tensor(

interpreter.get_output_details()[0]["index"]

)()

return style_bottleneck

# Calculate style bottleneck for the preprocessed style image.

style_bottleneck = run_style_predict(preprocessed_style_image)

print('Style Bottleneck Shape:', style_bottleneck.shape)

Style Bottleneck Shape: (1, 1, 1, 100)

Преобразование стиля

# Run style transform on preprocessed style image

def run_style_transform(style_bottleneck, preprocessed_content_image):

# Load the model.

interpreter = tf.lite.Interpreter(model_path=style_transform_path)

# Set model input.

input_details = interpreter.get_input_details()

interpreter.allocate_tensors()

# Set model inputs.

interpreter.set_tensor(input_details[0]["index"], preprocessed_content_image)

interpreter.set_tensor(input_details[1]["index"], style_bottleneck)

interpreter.invoke()

# Transform content image.

stylized_image = interpreter.tensor(

interpreter.get_output_details()[0]["index"]

)()

return stylized_image

# Stylize the content image using the style bottleneck.

stylized_image = run_style_transform(style_bottleneck, preprocessed_content_image)

# Visualize the output.

imshow(stylized_image, 'Stylized Image')

Смешивание стилей

Мы можем смешать стиль изображения содержимого со стилизованным выводом, что, в свою очередь, сделает вывод больше похожим на изображение содержимого.

# Calculate style bottleneck of the content image.

style_bottleneck_content = run_style_predict(

preprocess_image(content_image, 256)

)

# Define content blending ratio between [0..1].

# 0.0: 0% style extracts from content image.

# 1.0: 100% style extracted from content image.

content_blending_ratio = 0.5

# Blend the style bottleneck of style image and content image

style_bottleneck_blended = content_blending_ratio * style_bottleneck_content \

+ (1 - content_blending_ratio) * style_bottleneck

# Stylize the content image using the style bottleneck.

stylized_image_blended = run_style_transform(style_bottleneck_blended,

preprocessed_content_image)

# Visualize the output.

imshow(stylized_image_blended, 'Blended Stylized Image')

Тесты производительности

Номера тестов производительности создаются с помощью инструмента , описанного здесь .

| Наименование модели | Размер модели | Устройство | ННАПИ | Процессор | GPU |

|---|---|---|---|---|---|

| Модель прогнозирования стиля (int8) | 2,8 Мб | Pixel 3 (Android 10) | 142 мс | 14 мс | |

| Pixel 4 (Android 10) | 5,2 мс | 6,7 мс | |||

| iPhone XS (iOS 12.4.1) | 10,7 мс | ||||

| Модель преобразования стиля (int8) | 0,2 Мб | Pixel 3 (Android 10) | 540 мс | ||

| Pixel 4 (Android 10) | 405 мс | ||||

| iPhone XS (iOS 12.4.1) | 251 мс | ||||

| Модель прогнозирования стиля (float16) | 4,7 Мб | Pixel 3 (Android 10) | 86 мс | 28 мс | 9,1 мс |

| Pixel 4 (Android 10) | 32 мс | 12 мс | 10 мс | ||

| Модель переноса стиля (float16) | 0,4 Мб | Pixel 3 (Android 10) | 1095 мс | 545 мс | 42 мс |

| Pixel 4 (Android 10) | 603 мс | 377 мс | 42 мс |

* Использовано 4 нитки.

** 2 потока на iPhone для лучшей производительности.