Aprende a integrar las prácticas de Responsible AI en el flujo de trabajo de AA con TensorFlow

TensorFlow asume el compromiso de contribuir al desarrollo responsable de la IA compartiendo un conjunto de recursos y herramientas con la comunidad de AA.

¿Qué es Responsible AI?

El desarrollo de la IA genera nuevas oportunidades para resolver problemas complejos del mundo real. Además, genera nuevas preguntas sobre la mejor forma de crear sistemas de IA beneficiosos para todas las personas.

Prácticas recomendadas para la IA

El diseño de los sistemas de IA debe cumplir con las prácticas recomendadas para el desarrollo de software y aplicar un

enfoque de la AA centrado en las personas.

Equidad

Debido a que el impacto de la IA aumenta en todos los sectores y sociedades, es de suma importancia trabajar para lograr sistemas equitativos que incluyan a todo tipo de público.

Interpretabilidad

Es importante comprender y confiar en los sistemas de IA para asegurarse de que funcionen correctamente.

Privacidad

Para entrenar modelos por medio del uso de datos sensibles es necesario proteger y preservar la privacidad.

Seguridad

Identificar posibles amenazas sirve para mantener los sistemas de IA seguros y protegidos.

Responsible AI en el flujo de trabajo de AA

Se pueden incorporar las prácticas de Responsible AI en cada paso del flujo de trabajo de AA. A continuación se incluyen algunas preguntas clave que deben tenerse en cuenta en cada etapa.

¿A quién está dirigido mi sistema de AA?

La forma en que los usuarios reales experimentan el sistema es fundamental para evaluar el verdadero impacto de sus predicciones, recomendaciones y decisiones. Asegúrate de que un conjunto de usuarios diverso proporcione sus opiniones al comienzo del proceso de desarrollo.

¿Estoy usando un conjunto de datos representativo?

¿Tu muestreo de datos representa a los usuarios? (p. ej. se utilizará para todas las edades, pero solo tienes datos de entrenamiento correspondientes a adultos mayores).¿El muestreo representa escenarios de la vida real? (p. ej. se utilizará para todo el año, pero solo hay datos de entrenamiento correspondientes al verano).

¿Hay algún grado de sesgo humano o del mundo real en mis datos?

Es posible que los sesgos subyacentes en los datos contribuyan a ciclos de reacción complejos que acentúen los estereotipos existentes.

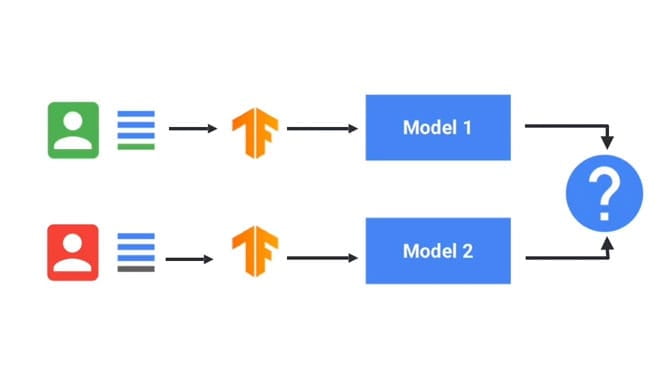

¿Qué métodos debería utilizar para entrenar mi modelo?

Usa métodos de entrenamiento que aporten equidad, interpretabilidad, privacidad y seguridad al modelo.

¿Cuál es el rendimiento de mi modelo?

Evalúa la experiencia del usuario en escenarios de la vida real teniendo en cuenta una amplia variedad de usuarios, casos de uso y contextos de uso. Primero ensaya y realiza iteraciones mediante pruebas internas; luego haz pruebas de forma constante después del lanzamiento.

¿Hay ciclos de reacción complejos?

Incluso si se pensó minuciosamente cada detalle del diseño del sistema en general, los modelos basados en el AA pocas veces funcionan con una efectividad absoluta cuando se aplican a datos reales y en tiempo real. Si surge algún problema con un producto en funcionamiento, evalúa si responde a alguna desventaja social existente y el impacto que tendrán en el producto las soluciones a corto y largo plazo.

Herramientas de Responsible AI para TensorFlow

El ecosistema de TensorFlow cuenta con un conjunto de herramientas y recursos para ayudar a resolver algunas de las preguntas anteriores.

Define el problema

Usa los siguientes recursos para diseñar modelos con Responsible AI.

Obtén más información sobre el proceso de desarrollo de IA y las consideraciones clave.

Usa visualizaciones interactivas para explorar preguntas y conceptos clave del campo de la Responsible AI.

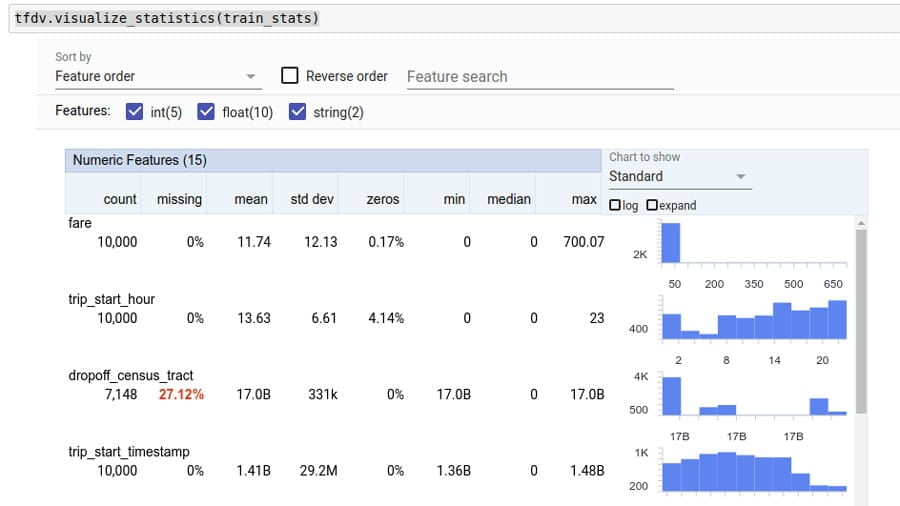

Construye y prepara datos

Usa las siguientes herramientas para examinar los datos a fin de encontrar posibles sesgos.

Investiga tu conjunto de datos de forma interactiva para mejorar la calidad de los datos y mitigar los problemas de equidad y sesgo.

Analiza y transforma datos para detectar problemas y diseñar conjuntos de atributos más eficaces.

Una escala de tonos de piel más inclusiva, de licencia abierta, para que tus necesidades de recopilación de datos y de compilación de modelos sean cubiertas de manera más sólida e inclusiva.

Crea y entrena un modelo

Usa las siguientes herramientas para entrenar modelos, a la vez que preservas la privacidad, usas técnicas interpretables y mucho más.

Entrena modelos de aprendizaje automático para generar resultados más equitativos.

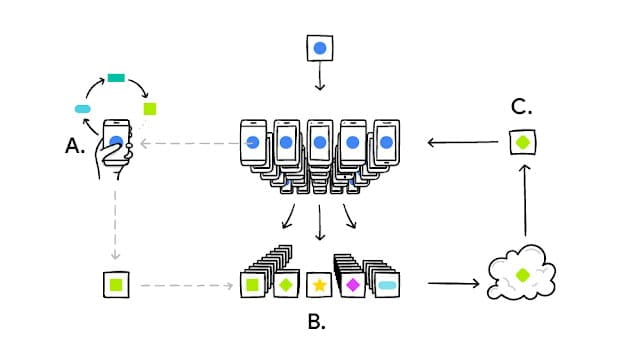

Usa técnicas de aprendizaje federado para entrenar modelos de aprendizaje automático.

Implementa modelos flexibles, interpretables y controlados basados en cuadrículas.

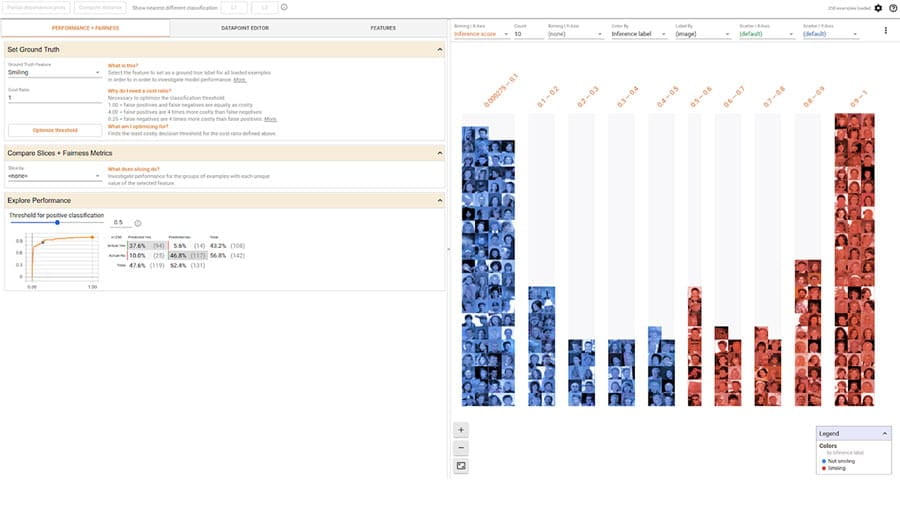

Evalúa el modelo

Usa las siguientes herramientas para depurar, evaluar y visualizar el funcionamiento del modelo.

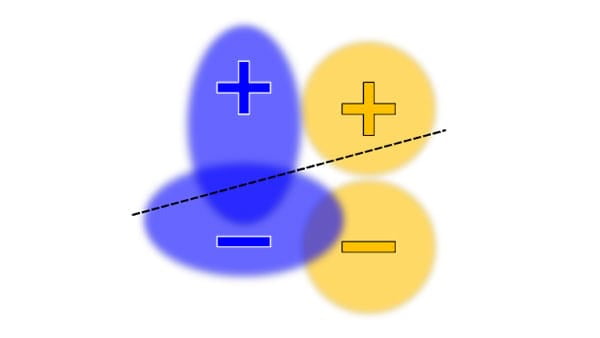

Evalúa las métricas de equidad que se identifican comúnmente con relación a clasificadores binarios y multiclase.

Evalúa modelos de forma distribuida y procesa diferentes segmentos de datos.

Desarrolla modelos de aprendizaje automático que sean interpretables e inclusivos.

Evalúa las propiedades de privacidad de los modelos de clasificación.

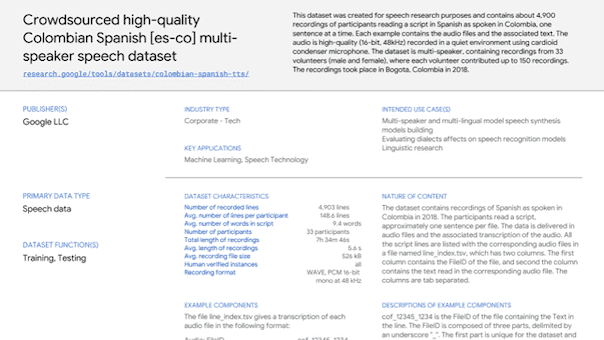

Implementa y supervisa

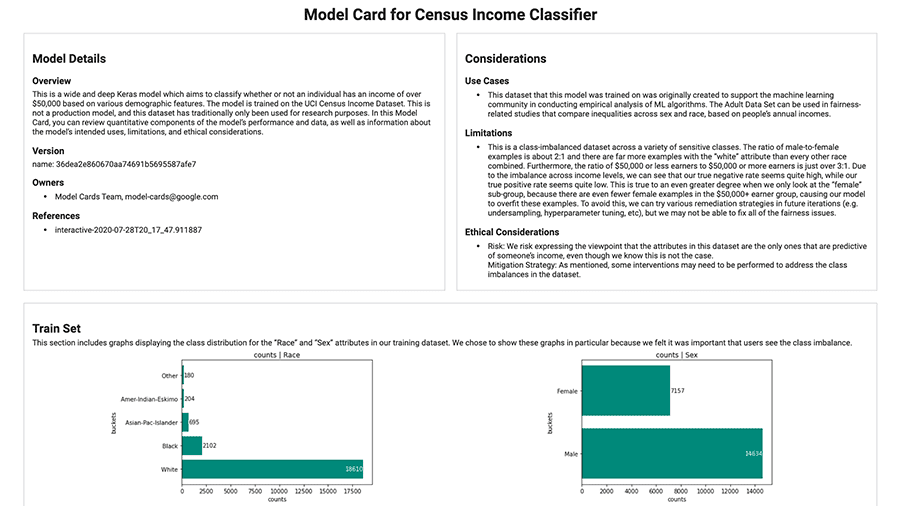

Usa las siguientes herramientas para hacer un seguimiento del contexto y los detalles del modelo, y para comunicar sobre ellos.

Usa el kit de herramientas Model Card para generar tarjetas de modelos con facilidad.

Registra y recupera metadatos asociados con flujos de trabajo de desarrolladores de AA y científicos de datos.

Organiza los datos fundamentales sobre aprendizaje automático de forma estructurada.

Recursos de la comunidad

Obtén información sobre lo que hace la comunidad y conoce formas de participar.

Ayuda a que los productos de Google sean más inclusivos y representen mejor tu lenguaje, región y cultura.

Les pedimos a los participantes que usaran TensorFlow 2.2 para crear un modelo o una aplicación teniendo en cuenta los principios de Responsible AI. Revisa la galería para ver los ganadores y otros proyectos asombrosos.

Presentación de un framework para reflexionar sobre el AA, la equidad y la privacidad.