Una vez que sus datos están en una canalización TFX, puede usar componentes TFX para analizarlos y transformarlos. Puede usar estas herramientas incluso antes de entrenar un modelo.

Hay muchas razones para analizar y transformar sus datos:

- Para encontrar problemas en sus datos. Los problemas comunes incluyen:

- Faltan datos, como características con valores vacíos.

- Etiquetas tratadas como características, de modo que su modelo pueda ver la respuesta correcta durante el entrenamiento.

- Características con valores fuera del rango esperado.

- Anomalías de datos.

- El modelo aprendido de transferencia tiene un preprocesamiento que no coincide con los datos de entrenamiento.

- Diseñar conjuntos de funciones más efectivos. Por ejemplo, puede identificar:

- Características especialmente informativas.

- Características redundantes.

- Características que varían tanto en escala que pueden retrasar el aprendizaje.

- Características con poca o ninguna información predictiva única.

Las herramientas TFX pueden ayudar a encontrar errores de datos y ayudar con la ingeniería de funciones.

Validación de datos de TensorFlow

- Visión general

- Validación de ejemplo basada en esquema

- Detección de sesgo de servicio de entrenamiento

- Detección de deriva

Visión general

TensorFlow Data Validation identifica anomalías en el entrenamiento y el servicio de datos, y puede crear automáticamente un esquema al examinar los datos. El componente se puede configurar para detectar diferentes clases de anomalías en los datos. Puede

- Realice comprobaciones de validez comparando estadísticas de datos con un esquema que codifica las expectativas del usuario.

- Detecte el sesgo entre la capacitación y el servicio comparando ejemplos en los datos de capacitación y servicio.

- Detecte la deriva de datos observando una serie de datos.

Documentamos cada una de estas funcionalidades de forma independiente:

- Validación de ejemplo basada en esquema

- Detección de sesgo de servicio de entrenamiento

- Detección de deriva

Validación de ejemplo basada en esquema

TensorFlow Data Validation identifica cualquier anomalía en los datos de entrada al comparar las estadísticas de datos con un esquema. El esquema codifica propiedades que se espera que satisfagan los datos de entrada, como tipos de datos o valores categóricos, y el usuario puede modificarlos o reemplazarlos.

La validación de datos de Tensorflow generalmente se invoca varias veces dentro del contexto de la canalización de TFX: (i) para cada división obtenida de ExampleGen, (ii) para todos los datos pretransformados utilizados por Transform y (iii) para todos los datos posteriores a la transformación generados por Transformar. Cuando se invoca en el contexto de Transform (ii-iii), las opciones de estadísticas y las restricciones basadas en esquemas se pueden establecer definiendo stats_options_updater_fn . Esto es particularmente útil cuando se validan datos no estructurados (por ejemplo, características de texto). Consulte el código de usuario para ver un ejemplo.

Funciones de esquema avanzadas

Esta sección cubre la configuración de esquemas más avanzada que puede ayudar con configuraciones especiales.

Características escasas

La codificación de características dispersas en los ejemplos generalmente presenta múltiples características que se espera que tengan la misma valencia para todos los ejemplos. Por ejemplo, la característica dispersa:

WeightedCategories = [('CategoryA', 0.3), ('CategoryX', 0.7)]

WeightedCategoriesIndex = ['CategoryA', 'CategoryX']

WeightedCategoriesValue = [0.3, 0.7]

sparse_feature {

name: 'WeightedCategories'

index_feature { name: 'WeightedCategoriesIndex' }

value_feature { name: 'WeightedCategoriesValue' }

}

La definición de característica dispersa requiere una o más características de índice y de valor que se refieren a características que existen en el esquema. La definición explícita de entidades dispersas permite a TFDV comprobar que las valencias de todas las entidades a las que se hace referencia coinciden.

Algunos casos de uso introducen restricciones de valencia similares entre funciones, pero no codifican necesariamente una función dispersa. El uso de la función escasa debería desbloquearlo, pero no es lo ideal.

Entornos de esquema

De forma predeterminada, las validaciones asumen que todos los ejemplos en una canalización se adhieren a un solo esquema. En algunos casos, es necesario introducir ligeras variaciones en el esquema, por ejemplo, las características utilizadas como etiquetas son necesarias durante el entrenamiento (y deben validarse), pero faltan durante el servicio. Los entornos se pueden utilizar para expresar dichos requisitos, en particular default_environment() , in_environment() , not_in_environment() .

Por ejemplo, suponga que se requiere una función llamada 'LABEL' para la capacitación, pero se espera que falte para el servicio. Esto se puede expresar por:

- Defina dos entornos distintos en el esquema: ["SERVING", "TRAINING"] y asocie 'LABEL' solo con el entorno "TRAINING".

- Asociar los datos de entrenamiento con el entorno "ENTRENAMIENTO" y los datos de servicio con el entorno "SERVICIO".

Generación de esquemas

El esquema de datos de entrada se especifica como una instancia de TensorFlow Schema .

En lugar de construir un esquema manualmente desde cero, un desarrollador puede confiar en la construcción automática de esquemas de TensorFlow Data Validation. Específicamente, TensorFlow Data Validation construye automáticamente un esquema inicial basado en estadísticas calculadas sobre datos de entrenamiento disponibles en la canalización. Los usuarios pueden simplemente revisar este esquema generado automáticamente, modificarlo según sea necesario, verificarlo en un sistema de control de versiones e insertarlo explícitamente en la canalización para una mayor validación.

TFDV incluye infer_schema() para generar un esquema automáticamente. Por ejemplo:

schema = tfdv.infer_schema(statistics=train_stats)

tfdv.display_schema(schema=schema)

Esto desencadena una generación automática de esquemas basada en las siguientes reglas:

Si un esquema ya se ha generado automáticamente, se utiliza tal cual.

De lo contrario, TensorFlow Data Validation examina las estadísticas de datos disponibles y calcula un esquema adecuado para los datos.

Nota: El esquema generado automáticamente es el mejor esfuerzo y solo intenta inferir las propiedades básicas de los datos. Se espera que los usuarios lo revisen y modifiquen según sea necesario.

Detección de sesgo de servicio de entrenamiento

Visión general

La validación de datos de TensorFlow puede detectar el sesgo de distribución entre los datos de entrenamiento y servicio. El sesgo de distribución ocurre cuando la distribución de los valores de características para los datos de entrenamiento es significativamente diferente de la distribución de los datos. Una de las causas clave del sesgo de distribución es el uso de un corpus completamente diferente para la generación de datos de entrenamiento para superar la falta de datos iniciales en el corpus deseado. Otra razón es un mecanismo de muestreo defectuoso que solo elige una submuestra de los datos de servicio para entrenar.

Escenario de ejemplo

Consulte la Guía de introducción a la validación de datos de TensorFlow para obtener información sobre cómo configurar la detección de sesgo de servicio de capacitación.

Detección de deriva

La detección de deriva es compatible entre tramos de datos consecutivos (es decir, entre el tramo N y el tramo N+1), como entre diferentes días de datos de entrenamiento. Expresamos la deriva en términos de distancia L-infinito para características categóricas y divergencia aproximada de Jensen-Shannon para características numéricas. Puede establecer la distancia del umbral para recibir advertencias cuando la desviación sea mayor de lo aceptable. Establecer la distancia correcta suele ser un proceso iterativo que requiere conocimiento y experimentación del dominio.

Consulte la Guía de introducción a la validación de datos de TensorFlow para obtener información sobre cómo configurar la detección de deriva.

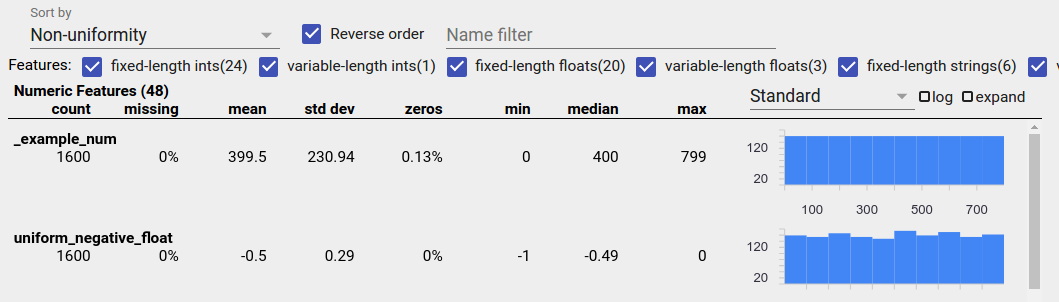

Uso de visualizaciones para verificar sus datos

TensorFlow Data Validation proporciona herramientas para visualizar la distribución de valores de características. Al examinar estas distribuciones en un cuaderno Jupyter con Facets , puede detectar problemas comunes con los datos.

Identificación de distribuciones sospechosas

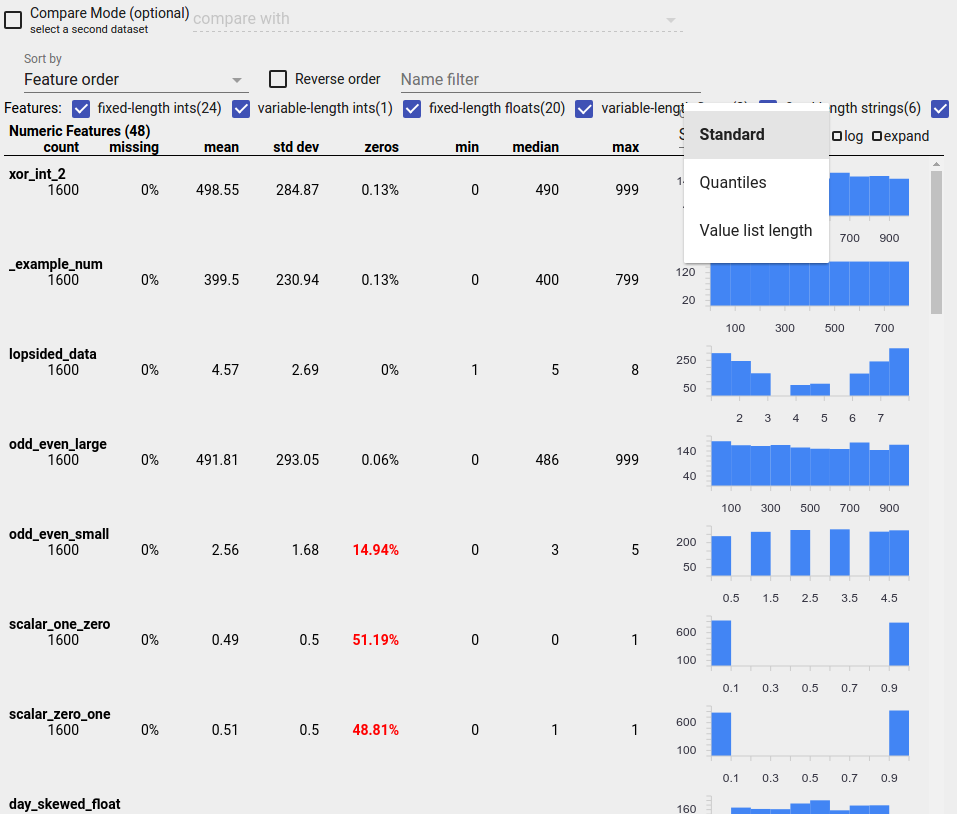

Puede identificar errores comunes en sus datos utilizando una visualización de descripción general de facetas para buscar distribuciones sospechosas de valores de características.

Datos desequilibrados

Una característica desequilibrada es una característica para la que predomina un valor. Las funciones desequilibradas pueden ocurrir naturalmente, pero si una función siempre tiene el mismo valor, es posible que tenga un error de datos. Para detectar características desequilibradas en una Vista general de facetas, elija "Sin uniformidad" en el menú desplegable "Ordenar por".

Las funciones más desequilibradas aparecerán en la parte superior de cada lista de tipos de funciones. Por ejemplo, la siguiente captura de pantalla muestra una característica que es todo ceros y una segunda que está muy desequilibrada, en la parte superior de la lista "Características numéricas":

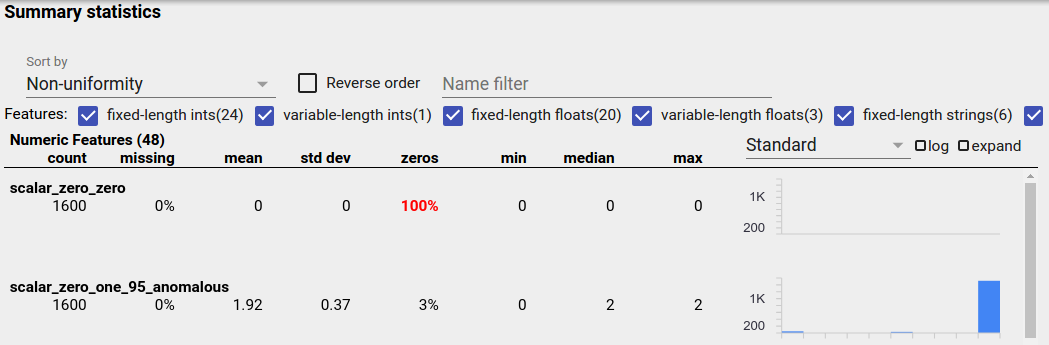

Datos distribuidos uniformemente

Una característica distribuida uniformemente es aquella en la que todos los valores posibles aparecen casi con la misma frecuencia. Al igual que con los datos desequilibrados, esta distribución puede ocurrir naturalmente, pero también puede ser producida por errores de datos.

Para detectar características distribuidas uniformemente en una Vista general de facetas, elija "Sin uniformidad" en el menú desplegable "Ordenar por" y marque la casilla de verificación "Orden inverso":

Los datos de cadena se representan mediante gráficos de barras si hay 20 o menos valores únicos y como un gráfico de distribución acumulativa si hay más de 20 valores únicos. Entonces, para los datos de cadena, las distribuciones uniformes pueden aparecer como gráficos de barras planas como el de arriba o como líneas rectas como el de abajo:

Errores que pueden producir datos distribuidos uniformemente

Aquí hay algunos errores comunes que pueden producir datos distribuidos uniformemente:

Uso de cadenas para representar tipos de datos que no son cadenas, como fechas. Por ejemplo, tendrá muchos valores únicos para una función de fecha y hora con representaciones como "2017-03-01-11-45-03". Los valores únicos se distribuirán uniformemente.

Incluir índices como "número de fila" como características. Aquí nuevamente tienes muchos valores únicos.

Datos perdidos

Para verificar si a una característica le faltan valores por completo:

- Elija "Cantidad faltante/cero" en el menú desplegable "Ordenar por".

- Marque la casilla de verificación "Orden inverso".

- Mire la columna "faltante" para ver el porcentaje de instancias con valores faltantes para una función.

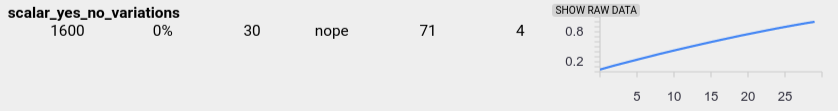

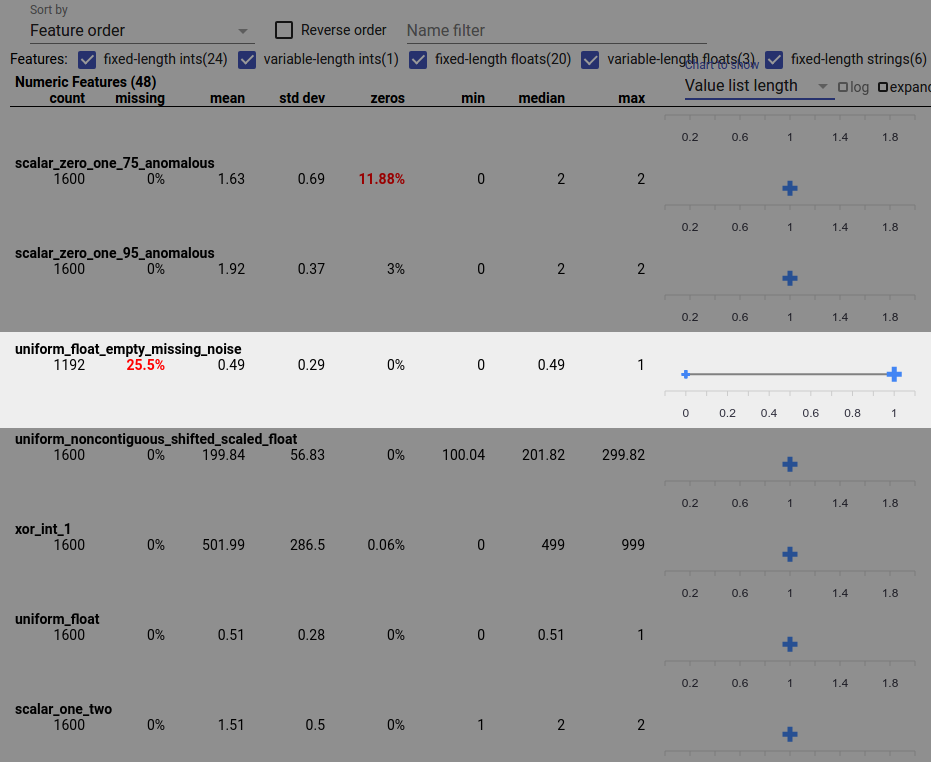

Un error de datos también puede causar valores de características incompletos. Por ejemplo, puede esperar que la lista de valores de una característica siempre tenga tres elementos y descubra que a veces solo tiene uno. Para verificar valores incompletos u otros casos en los que las listas de valores de características no tienen la cantidad esperada de elementos:

Elija "Longitud de la lista de valores" en el menú desplegable "Gráfico para mostrar" a la derecha.

Mire el gráfico a la derecha de cada fila de funciones. El gráfico muestra el rango de longitudes de la lista de valores para la característica. Por ejemplo, la fila resaltada en la siguiente captura de pantalla muestra una característica que tiene algunas listas de valores de longitud cero:

Grandes diferencias de escala entre entidades

Si sus funciones varían mucho en escala, es posible que el modelo tenga dificultades para aprender. Por ejemplo, si algunas características varían de 0 a 1 y otras varían de 0 a 1,000,000,000, tiene una gran diferencia de escala. Compare las columnas "máximo" y "mínimo" en las características para encontrar escalas muy variadas.

Considere la posibilidad de normalizar los valores de las características para reducir estas amplias variaciones.

Etiquetas con etiquetas no válidas

Los estimadores de TensorFlow tienen restricciones sobre el tipo de datos que aceptan como etiquetas. Por ejemplo, los clasificadores binarios normalmente solo funcionan con etiquetas {0, 1}.

Revise los valores de las etiquetas en la Descripción general de facetas y asegúrese de que cumplan con los requisitos de Estimadores .