TensorFlow.org এ দেখুন TensorFlow.org এ দেখুন |  Google Colab-এ চালান Google Colab-এ চালান |  GitHub এ দেখুন GitHub এ দেখুন |  নোটবুক ডাউনলোড করুন নোটবুক ডাউনলোড করুন |  TF হাব মডেল দেখুন TF হাব মডেল দেখুন |

এই Colab একটি জেনারেটিভ অ্যাডভারসারিয়াল নেটওয়ার্ক (GAN) এর উপর ভিত্তি করে একটি TF হাব মডিউলের ব্যবহার প্রদর্শন করে। মডিউল এন-ডাইমেনশনাল ভেক্টর থেকে ম্যাপ করে, যাকে সুপ্ত স্থান বলা হয়, আরজিবি চিত্রগুলিতে।

দুটি উদাহরণ প্রদান করা হয়:

- সুপ্ত স্থান থেকে ইমেজ ম্যাপিং, এবং

- লক্ষ্য ইমেজ দেওয়া, গ্রেডিয়েন্ট বংশদ্ভুত ব্যবহার করে একটি সুপ্ত ভেক্টর যে লক্ষ্য ইমেজ অনুরূপ একটি চিত্র তৈরি করে খুঁজে।

ঐচ্ছিক পূর্বশর্ত

- পরিচিতি নিম্ন স্তরের Tensorflow ধারণা ।

- সৃজক adversarial নেটওয়ার্ক উইকিপিডিয়া উপর।

- প্রগ্রেসিভ Gans কাগজ: প্রগ্রেসিভ উন্নত কোয়ালিটির, স্থায়িত্ব এবং প্রকরণ জন্য Gans ফলানোর ।

আরও মডেল

এখানে আপনি বর্তমানে হোস্ট করা সমস্ত মডেলের জানতে পারেন tfhub.dev ইমেজ তৈরি করতে পারেন।

সেটআপ

# Install imageio for creating animations.pip -q install imageiopip -q install scikit-imagepip install git+https://github.com/tensorflow/docs

আমদানি এবং ফাংশন সংজ্ঞা

from absl import logging

import imageio

import PIL.Image

import matplotlib.pyplot as plt

import numpy as np

import tensorflow as tf

tf.random.set_seed(0)

import tensorflow_hub as hub

from tensorflow_docs.vis import embed

import time

try:

from google.colab import files

except ImportError:

pass

from IPython import display

from skimage import transform

# We could retrieve this value from module.get_input_shapes() if we didn't know

# beforehand which module we will be using.

latent_dim = 512

# Interpolates between two vectors that are non-zero and don't both lie on a

# line going through origin. First normalizes v2 to have the same norm as v1.

# Then interpolates between the two vectors on the hypersphere.

def interpolate_hypersphere(v1, v2, num_steps):

v1_norm = tf.norm(v1)

v2_norm = tf.norm(v2)

v2_normalized = v2 * (v1_norm / v2_norm)

vectors = []

for step in range(num_steps):

interpolated = v1 + (v2_normalized - v1) * step / (num_steps - 1)

interpolated_norm = tf.norm(interpolated)

interpolated_normalized = interpolated * (v1_norm / interpolated_norm)

vectors.append(interpolated_normalized)

return tf.stack(vectors)

# Simple way to display an image.

def display_image(image):

image = tf.constant(image)

image = tf.image.convert_image_dtype(image, tf.uint8)

return PIL.Image.fromarray(image.numpy())

# Given a set of images, show an animation.

def animate(images):

images = np.array(images)

converted_images = np.clip(images * 255, 0, 255).astype(np.uint8)

imageio.mimsave('./animation.gif', converted_images)

return embed.embed_file('./animation.gif')

logging.set_verbosity(logging.ERROR)

সুপ্ত স্থান প্রসারণ

এলোমেলো ভেক্টর

দুটি এলোমেলোভাবে শুরু করা ভেক্টরের মধ্যে সুপ্ত স্থান ইন্টারপোলেশন। আমরা একটি TF হাব মডিউল ব্যবহার করা হবে progan-128 যে একটি প্রাক প্রশিক্ষিত প্রগ্রেসিভ GAN ধারণ করে।

progan = hub.load("https://tfhub.dev/google/progan-128/1").signatures['default']

def interpolate_between_vectors():

v1 = tf.random.normal([latent_dim])

v2 = tf.random.normal([latent_dim])

# Creates a tensor with 25 steps of interpolation between v1 and v2.

vectors = interpolate_hypersphere(v1, v2, 50)

# Uses module to generate images from the latent space.

interpolated_images = progan(vectors)['default']

return interpolated_images

interpolated_images = interpolate_between_vectors()

animate(interpolated_images)

সুপ্ত স্থানের নিকটতম ভেক্টর সন্ধান করা

একটি লক্ষ্য চিত্র ঠিক করুন. উদাহরণ হিসেবে মডিউল থেকে তৈরি একটি ছবি ব্যবহার করুন বা আপনার নিজের আপলোড করুন।

image_from_module_space = True # @param { isTemplate:true, type:"boolean" }

def get_module_space_image():

vector = tf.random.normal([1, latent_dim])

images = progan(vector)['default'][0]

return images

def upload_image():

uploaded = files.upload()

image = imageio.imread(uploaded[list(uploaded.keys())[0]])

return transform.resize(image, [128, 128])

if image_from_module_space:

target_image = get_module_space_image()

else:

target_image = upload_image()

display_image(target_image)

লক্ষ্য চিত্র এবং একটি সুপ্ত স্থান পরিবর্তনশীল দ্বারা উত্পন্ন চিত্রের মধ্যে একটি ক্ষতি ফাংশন সংজ্ঞায়িত করার পরে, আমরা পরিবর্তনশীল মানগুলি খুঁজে পেতে গ্রেডিয়েন্ট ডিসেন্ট ব্যবহার করতে পারি যা ক্ষতি কমিয়ে দেয়।

tf.random.set_seed(42)

initial_vector = tf.random.normal([1, latent_dim])

display_image(progan(initial_vector)['default'][0])

def find_closest_latent_vector(initial_vector, num_optimization_steps,

steps_per_image):

images = []

losses = []

vector = tf.Variable(initial_vector)

optimizer = tf.optimizers.Adam(learning_rate=0.01)

loss_fn = tf.losses.MeanAbsoluteError(reduction="sum")

for step in range(num_optimization_steps):

if (step % 100)==0:

print()

print('.', end='')

with tf.GradientTape() as tape:

image = progan(vector.read_value())['default'][0]

if (step % steps_per_image) == 0:

images.append(image.numpy())

target_image_difference = loss_fn(image, target_image[:,:,:3])

# The latent vectors were sampled from a normal distribution. We can get

# more realistic images if we regularize the length of the latent vector to

# the average length of vector from this distribution.

regularizer = tf.abs(tf.norm(vector) - np.sqrt(latent_dim))

loss = target_image_difference + regularizer

losses.append(loss.numpy())

grads = tape.gradient(loss, [vector])

optimizer.apply_gradients(zip(grads, [vector]))

return images, losses

num_optimization_steps=200

steps_per_image=5

images, loss = find_closest_latent_vector(initial_vector, num_optimization_steps, steps_per_image)

.................................................................................................... ....................................................................................................

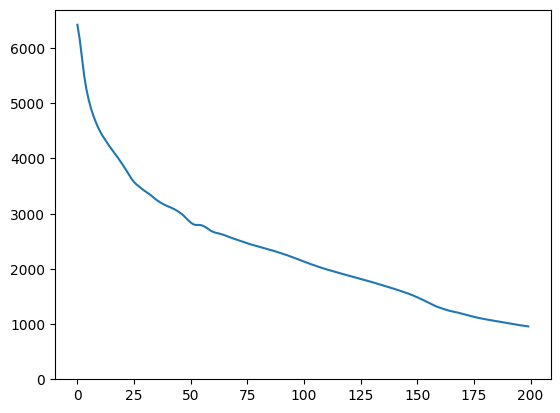

plt.plot(loss)

plt.ylim([0,max(plt.ylim())])

(0.0, 6696.301751708985)

animate(np.stack(images))

লক্ষ্যের সাথে ফলাফলের তুলনা করুন:

display_image(np.concatenate([images[-1], target_image], axis=1))

উপরের উদাহরণ দিয়ে খেলা

যদি চিত্রটি মডিউল স্থান থেকে হয়, তাহলে অবতরণ দ্রুত হয় এবং একটি যুক্তিসঙ্গত নমুনায় রূপান্তরিত হয়। এমন একটি চিত্র মডিউল স্থান থেকে নয় সাজানো চেষ্টা করে দেখুন। ডিসেন্ট শুধুমাত্র তখনই একত্রিত হবে যদি ইমেজটি ট্রেনিং ইমেজের জায়গার কাছাকাছি থাকে।

কিভাবে এটি দ্রুত এবং আরো বাস্তবসম্মত ইমেজ নামা করতে? কেউ চেষ্টা করতে পারেন:

- চিত্রের পার্থক্যে বিভিন্ন ক্ষতি ব্যবহার করে, যেমন দ্বিঘাত,

- সুপ্ত ভেক্টরে বিভিন্ন রেগুলার ব্যবহার করে,

- একাধিক রানে একটি এলোমেলো ভেক্টর থেকে শুরু করা,

- ইত্যাদি