- Descriptif :

L'ensemble de données Places est conçu selon les principes de la cognition visuelle humaine. Notre objectif est de construire un noyau de connaissances visuelles pouvant être utilisé pour former des systèmes artificiels pour des tâches de compréhension visuelle de haut niveau, telles que le contexte de la scène, la reconnaissance d'objets, la prédiction d'actions et d'événements et l'inférence de la théorie de l'esprit.

Les catégories sémantiques des Lieux sont définies par leur fonction : les étiquettes représentent l'entrée de gamme d'un environnement. Pour illustrer, le jeu de données a différentes catégories de chambres, ou de rues, etc., car on n'agit pas de la même manière, et on ne fait pas les mêmes prédictions de ce qui peut arriver ensuite, dans une chambre de maison, une chambre d'hôtel ou une crèche. Au total, Places contient plus de 10 millions d'images comprenant plus de 400 catégories de scènes uniques. L'ensemble de données comprend 5 000 à 30 000 images d'entraînement par classe, conformément aux fréquences d'occurrence réelles. À l'aide de réseaux de neurones convolutifs (CNN), l'ensemble de données Places permet d'apprendre des caractéristiques de scène profondes pour diverses tâches de reconnaissance de scène, dans le but d'établir de nouvelles performances de pointe sur des repères centrés sur la scène.

Ici, nous fournissons la base de données des lieux et les CNN formés à des fins de recherche universitaire et d'éducation.

Page d' accueil : http://places2.csail.mit.edu/

Code source :

tfds.datasets.placesfull.BuilderVersions :

-

1.0.0(par défaut) : aucune note de version.

-

Taille du téléchargement :

143.56 GiBTaille du jeu de données :

136.56 GiBMise en cache automatique ( documentation ): Non

Fractionnements :

| Diviser | Exemples |

|---|---|

'train' | 10 653 087 |

- Structure des fonctionnalités :

FeaturesDict({

'filename': Text(shape=(), dtype=string),

'image': Image(shape=(256, 256, 3), dtype=uint8),

'label': ClassLabel(shape=(), dtype=int64, num_classes=435),

})

- Documentation des fonctionnalités :

| Caractéristique | Classer | Forme | Dtype | La description |

|---|---|---|---|---|

| FonctionnalitésDict | ||||

| nom de fichier | Texte | chaîne de caractères | ||

| image | Image | (256, 256, 3) | uint8 | |

| étiquette | Étiquette de classe | int64 |

Clés supervisées (Voir

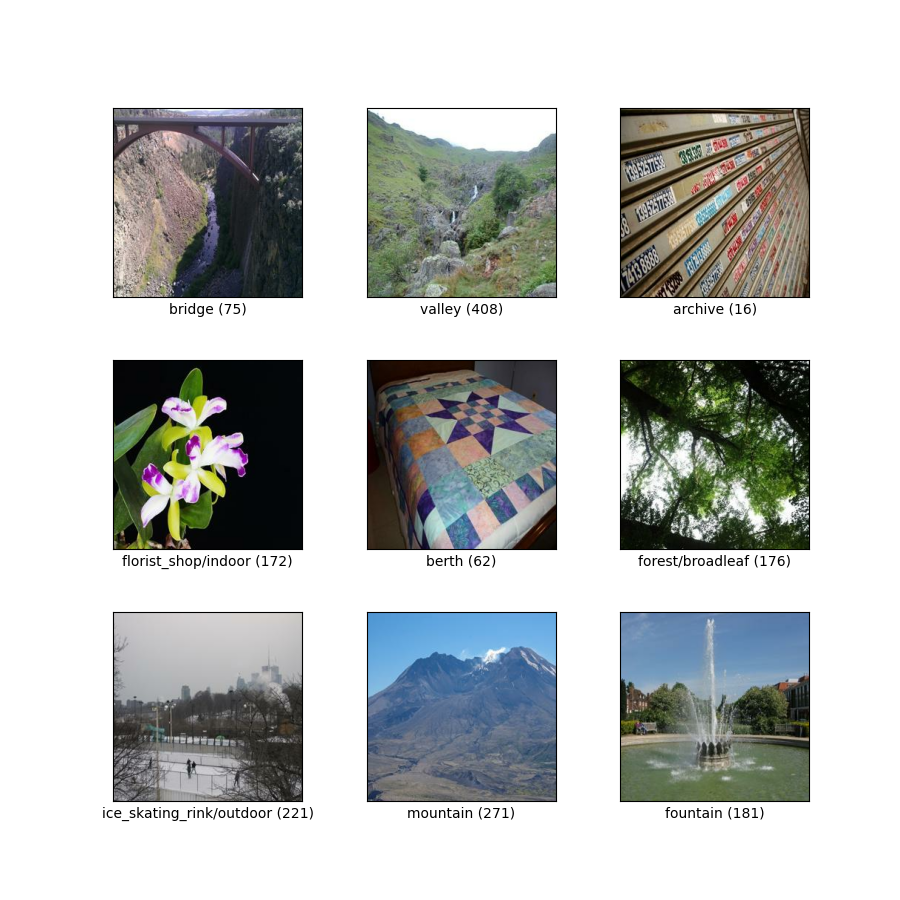

as_superviseddoc ):('image', 'label', 'filename')Figure ( tfds.show_examples ):

- Exemples ( tfds.as_dataframe ):

- Citation :

@article{zhou2017places,

title={Places: A 10 million Image Database for Scene Recognition},

author={Zhou, Bolei and Lapedriza, Agata and Khosla, Aditya and Oliva, Aude and Torralba, Antonio},

journal={IEEE Transactions on Pattern Analysis and Machine Intelligence},

year={2017},

publisher={IEEE}

}