- opis :

Zestaw danych Google RefExp to zbiór opisów tekstowych obiektów na obrazach, który opiera się na publicznie dostępnym zbiorze danych MS-COCO. Podczas gdy podpisy obrazów w MS-COCO odnoszą się do całego obrazu, ten zestaw danych koncentruje się na opisach tekstowych, które pozwalają jednoznacznie zidentyfikować pojedynczy obiekt lub region na obrazie. Zobacz więcej szczegółów w tym artykule: Generowanie i rozumienie jednoznacznych opisów obiektów.

Dodatkowa dokumentacja : Przeglądaj dokumenty z kodem na

Strona główna : https://github.com/mjhucla/Google_Refexp_toolbox

Kod źródłowy :

tfds.vision_language.gref.GrefWersje :

-

1.0.0(domyślnie): Wersja początkowa.

-

Rozmiar pliku do pobrania :

Unknown sizeRozmiar zestawu danych :

4.60 GiBInstrukcje ręcznego pobierania : ten zestaw danych wymaga ręcznego pobrania danych źródłowych do katalogu

download_config.manual_dir(domyślnie~/tensorflow_datasets/downloads/manual/):

Postępuj zgodnie z instrukcjami na stronie https://github.com/mjhucla/Google_Refexp_toolbox , aby pobrać i wstępnie przetworzyć dane do formatu zgodnego z COCO. Katalog zawiera 2 pliki i jeden folder:google_refexp_train_201511_coco_aligned_catg.json

google_refexp_val_201511_coco_aligned_catg.json

coco_pociąg2014/

Folder coco_train2014 zawiera wszystkie obrazy szkoleniowe COCO 2014.

Automatyczne buforowanie ( dokumentacja ): Nie

Podziały :

| Rozdzielać | Przykłady |

|---|---|

'train' | 24698 |

'validation' | 4650 |

- Struktura funkcji :

FeaturesDict({

'image': Image(shape=(None, None, 3), dtype=uint8),

'image/id': int64,

'objects': Sequence({

'area': int64,

'bbox': BBoxFeature(shape=(4,), dtype=float32),

'id': int64,

'label': int64,

'label_name': ClassLabel(shape=(), dtype=int64, num_classes=80),

'refexp': Sequence({

'raw': Text(shape=(), dtype=string),

'referent': Text(shape=(), dtype=string),

'refexp_id': int64,

'tokens': Sequence(Text(shape=(), dtype=string)),

}),

}),

})

- Dokumentacja funkcji :

| Funkcja | Klasa | Kształt | Typ D | Opis |

|---|---|---|---|---|

| FunkcjeDict | ||||

| obraz | Obraz | (Brak, Brak, 3) | uint8 | |

| obraz/identyfikator | Napinacz | int64 | ||

| obiekty | Sekwencja | |||

| obiekty/obszar | Napinacz | int64 | ||

| obiekty/bbox | Funkcja BBox | (4,) | pływak32 | |

| obiekty/identyfikator | Napinacz | int64 | ||

| obiekty/etykieta | Napinacz | int64 | ||

| obiekty/nazwa_etykiety | Etykieta klasy | int64 | ||

| obiekty/odzw | Sekwencja | |||

| obiekty/refexp/raw | Tekst | strunowy | ||

| obiekty/odnośnik/odnośnik | Tekst | strunowy | ||

| obiekty/refexp/refexp_id | Napinacz | int64 | ||

| obiekty/refexp/tokeny | Sekwencja (tekst) | (Nic,) | strunowy |

Klucze nadzorowane (Zobacz dokument

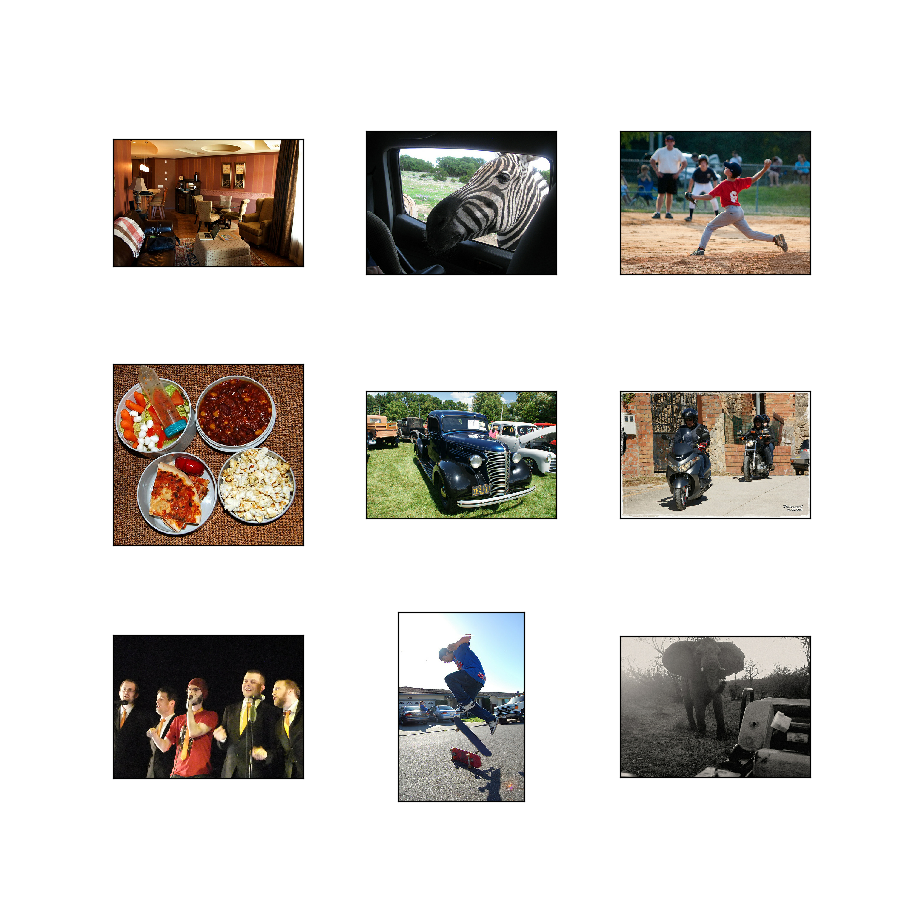

as_supervised):NoneRysunek ( tfds.show_examples ):

- Przykłady ( tfds.as_dataframe ):

- Cytat :

@inproceedings{mao2016generation,

title={Generation and Comprehension of Unambiguous Object Descriptions},

author={Mao, Junhua and Huang, Jonathan and Toshev, Alexander and Camburu, Oana and Yuille, Alan and Murphy, Kevin},

booktitle={CVPR},

year={2016}

}